OpenClaw e Moltbook: perché un forum per soli agenti AI è interessante?

In questi giorni tutti stanno parlando di OpenClaw e Moltbook e ho fatto una cosa che non consiglio di fare a cuor leggero: li ho provati.

OpenClaw e Moltbook: perché un forum per soli agenti AI è interessante?

In questi giorni tutti stanno parlando di OpenClaw e Moltbook e ho fatto una cosa che non consiglio di fare a cuor leggero: li ho provati.

Hackapizza 2.0: il più grande hackathon sull'AI in Italia

L’anno scorso abbiamo organizzato il nostro primo hackathon sulla l‘AI. Quest’anno vogliamo spingerci oltre: ecco Hackapizza 2.0.

AI e competenze umane: il report di Anthropic

Anthropic ha appena rilasciato un nuovo report sull’uso dell’AI e sul suo impatto economico. E conferma una cosa importantissima.

Lessons from Testing Contextual Retrieval on Multiple Datasets

We tested Contextual Retrieval across multiple datasets to understand whether it still improves RAG systems in 2026, compared to base retrieval and modern rerankers. Here's what we found

Claude Code: perché tutti ne parlano?

Oggi vi vorrei parlare di Claude Code senza filtri. E non vedevo l’ora.

Cosa abbiamo imparato testando la Contextual Retrieval su diversi dataset

Abbiamo testato la Contextual Retrieval su diversi dataset per capire se nel 2026 migliora davvero i sistemi RAG, confrontandola con il retrieval base e con l’aggiunta di reranker moderni. Ecco cosa abbiamo scoperto

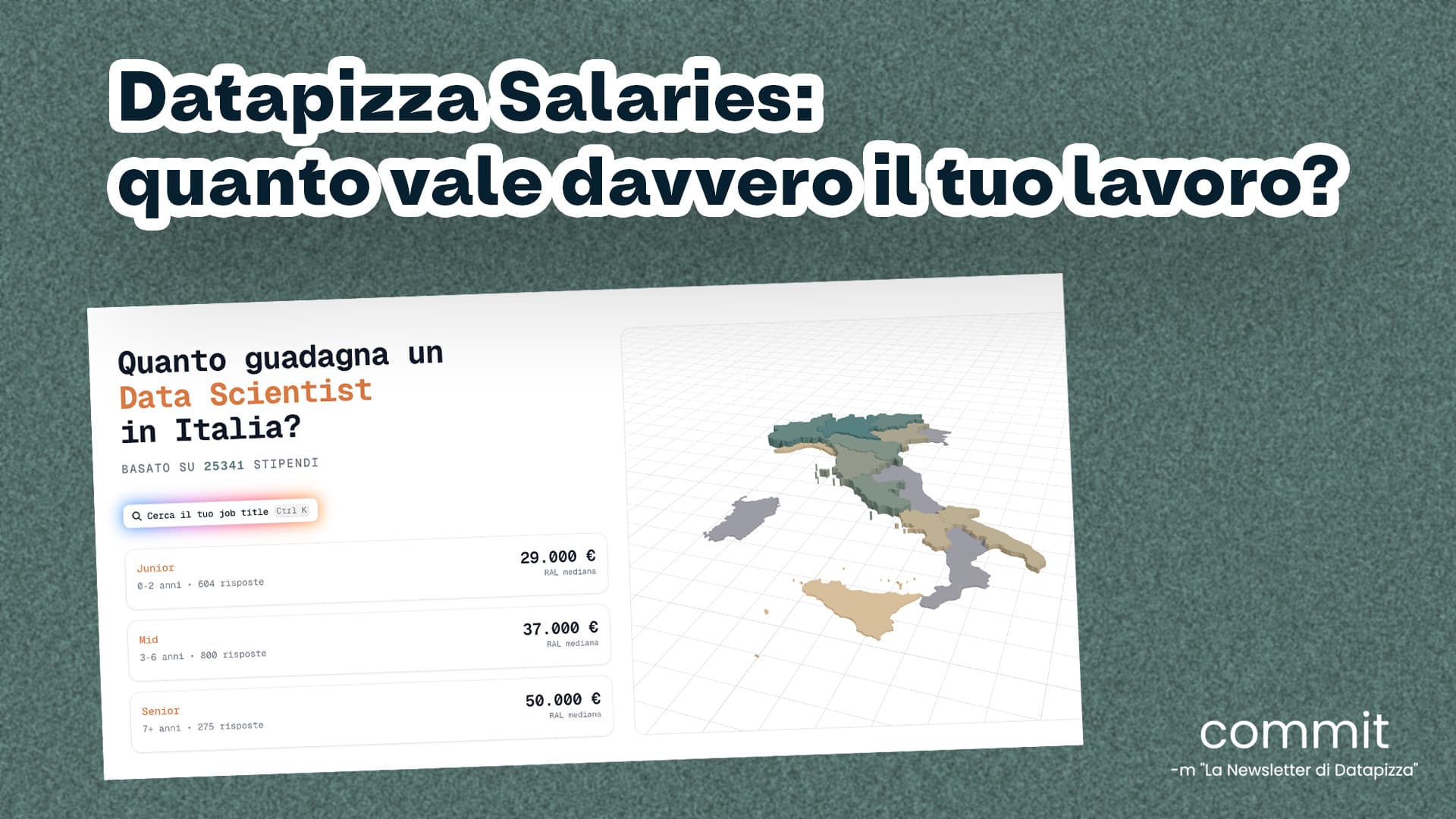

Datapizza Salaries: quanto vale davvero il tuo lavoro?

In Datapizza abbiamo fatto una cosa che, nel tech italiano, sembra ancora radicale e devo assolutamente parlarne.

Claude Opus 4.5 e lo stato della GenAI

Neanche il tempo di abituarci a Gemini 3 Pro, che Anthropic ha rilanciato con un nuovo modello di Claude… e cavolo se c’è roba da dire!

Nano Banana Pro e NotebookLM: Google è inarrestabile

C’è una bomba AI che Google ha rilasciato settimana scorsa di cui non ti ho ancora parlato - Nano Banana Pro - e non è tutto!