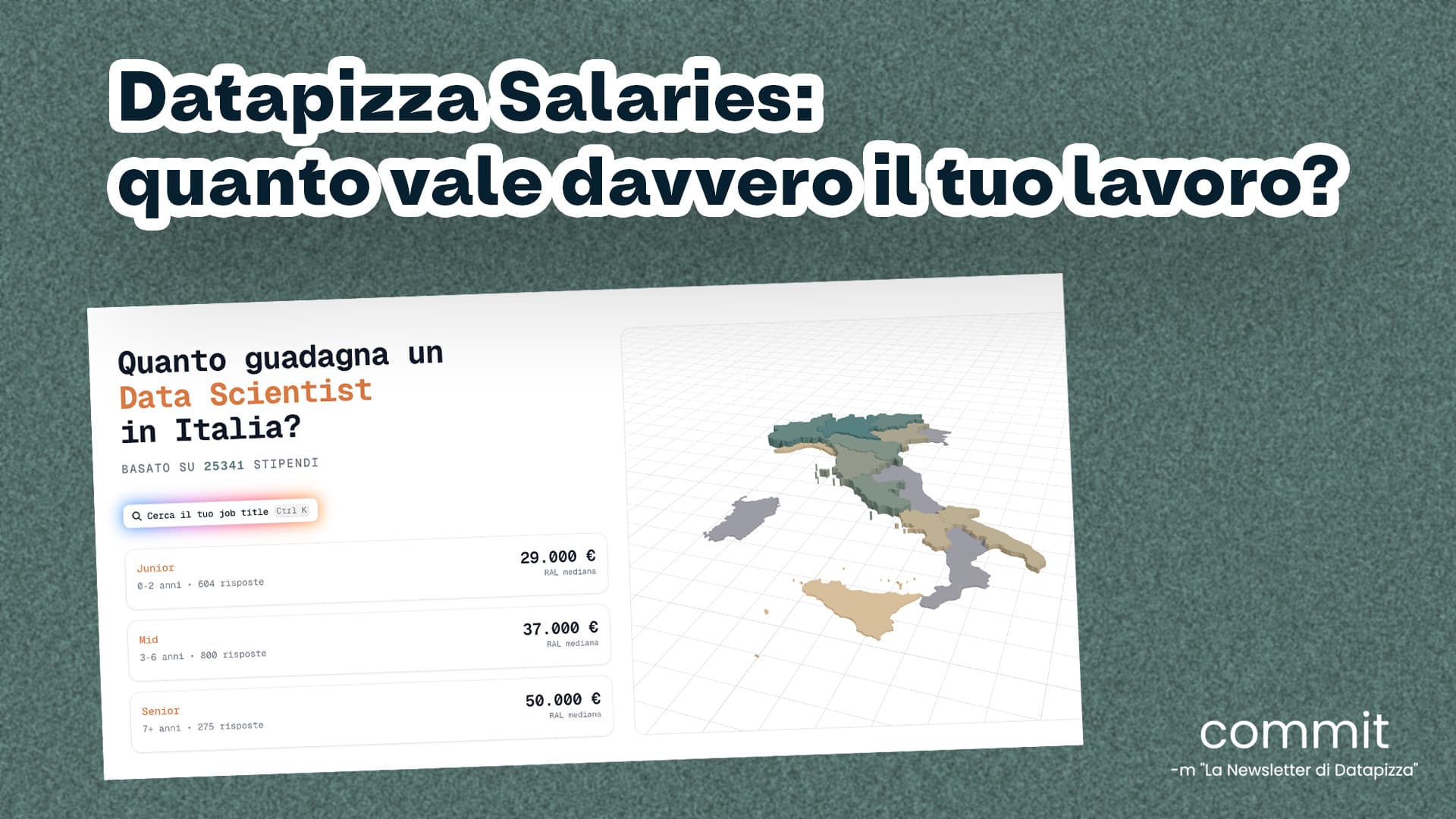

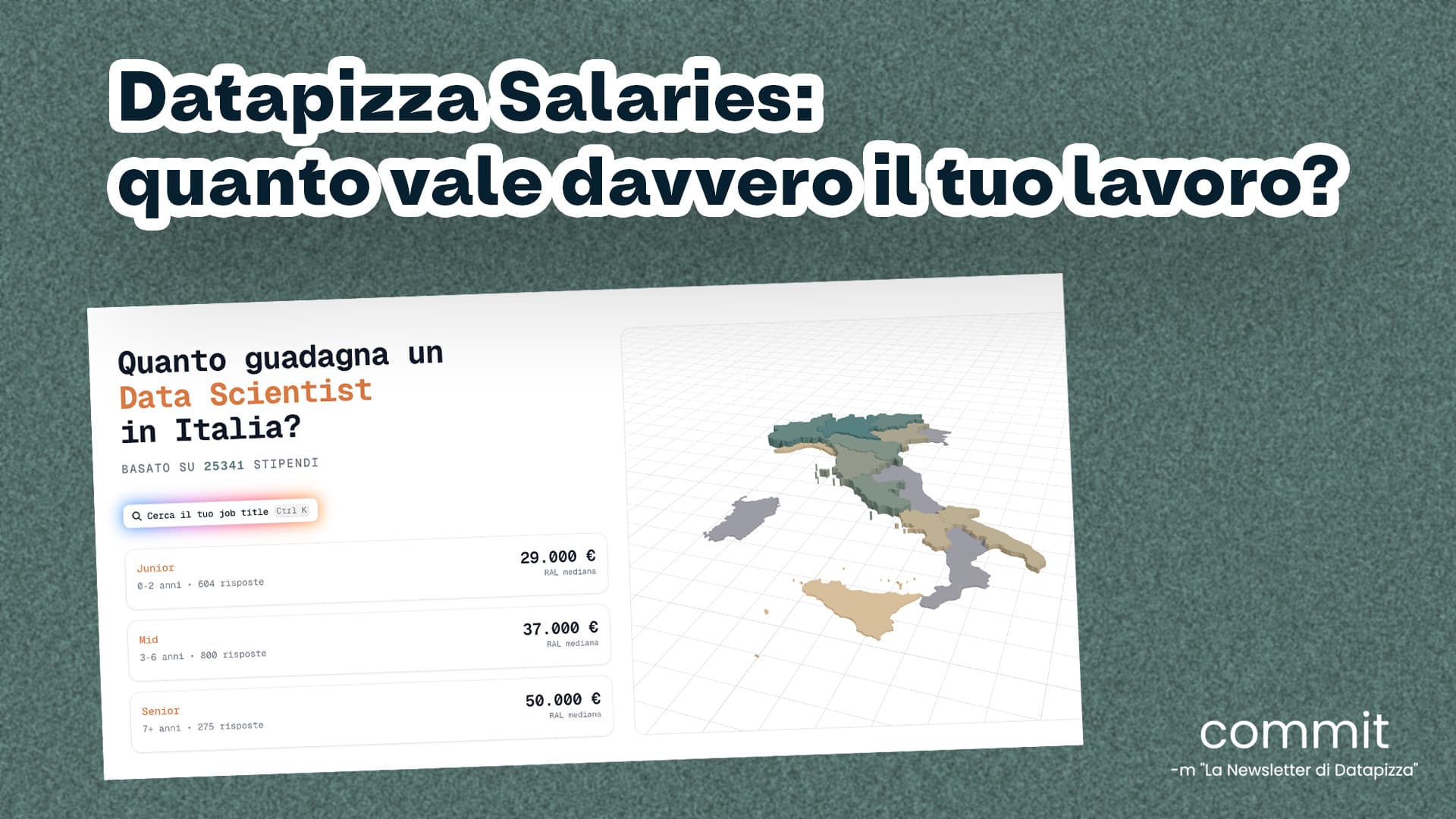

Datapizza Salaries: quanto vale davvero il tuo lavoro?

In Datapizza abbiamo fatto una cosa che, nel tech italiano, sembra ancora radicale e devo assolutamente parlarne.

Datapizza Salaries: quanto vale davvero il tuo lavoro?

In Datapizza abbiamo fatto una cosa che, nel tech italiano, sembra ancora radicale e devo assolutamente parlarne.

Claude Opus 4.5 e lo stato della GenAI

Neanche il tempo di abituarci a Gemini 3 Pro, che Anthropic ha rilanciato con un nuovo modello di Claude… e cavolo se c’è roba da dire!

Nano Banana Pro e NotebookLM: Google è inarrestabile

C’è una bomba AI che Google ha rilasciato settimana scorsa di cui non ti ho ancora parlato - Nano Banana Pro - e non è tutto!

Gemini 3: tutte le novità

Pochi giorni fa Google ha rilasciato finalmente Gemini 3 e Antigravity. E devo assolutamente parlartene, perché la sostanza è parecchia!

AI Transformation Advisor: una guida pratica al ruolo

In questi giorni ho pubblicato una guida sull’AI Transformation Advisor, che ti consiglio caldamente di leggere per capire in che direzione sta andando la trasformazione che stiamo vivendo.

RAG Evaluation: Using Claude Skills to craft a truly challenging Q&A set

To truly evaluate a RAG system, public benchmarks aren’t enough—you need datasets that reflect real-world difficulty, including multi-hop questions, wide reasoning, and heterogeneous knowledge bases. In this article, we show how we designed a char-based, chunk-agnostic framework with easy/medium difficulty levels and human validation, leveraging Claude Skills and LLM retrievers to generate questions, answers, and evidence spans. The result is a public dataset based on D&D SRD 5.2.1 (plus two internal datasets), built for reproducible and comparable RAG pipeline testing.

Evaluation per RAG: usare Claude Skills per progettare un dataset Q&A di livello avanzato

Per valutare davvero una RAG non bastano i benchmark pubblici: servono dataset che riflettano difficoltà reali come domande multi-hop, wide e knowledge base eterogenee. In questo articolo mostriamo come abbiamo progettato un framework char-based, chunk-agnostic, con livelli easy/medium e controllo umano, e come usiamo Claude Skills e LLM retriever per generare domande, risposte e passaggi. Il risultato è un dataset pubblico basato su D&D SRD 5.2.1 (più due dataset interni) pensato per testing riproducibile e comparabile di diverse pipeline di RAG.

La strada verso l'AGI: a che punto siamo?

In questi giorni è uscito un paper molto figo (e molto serio) sull’AGI e volevo parlartene.

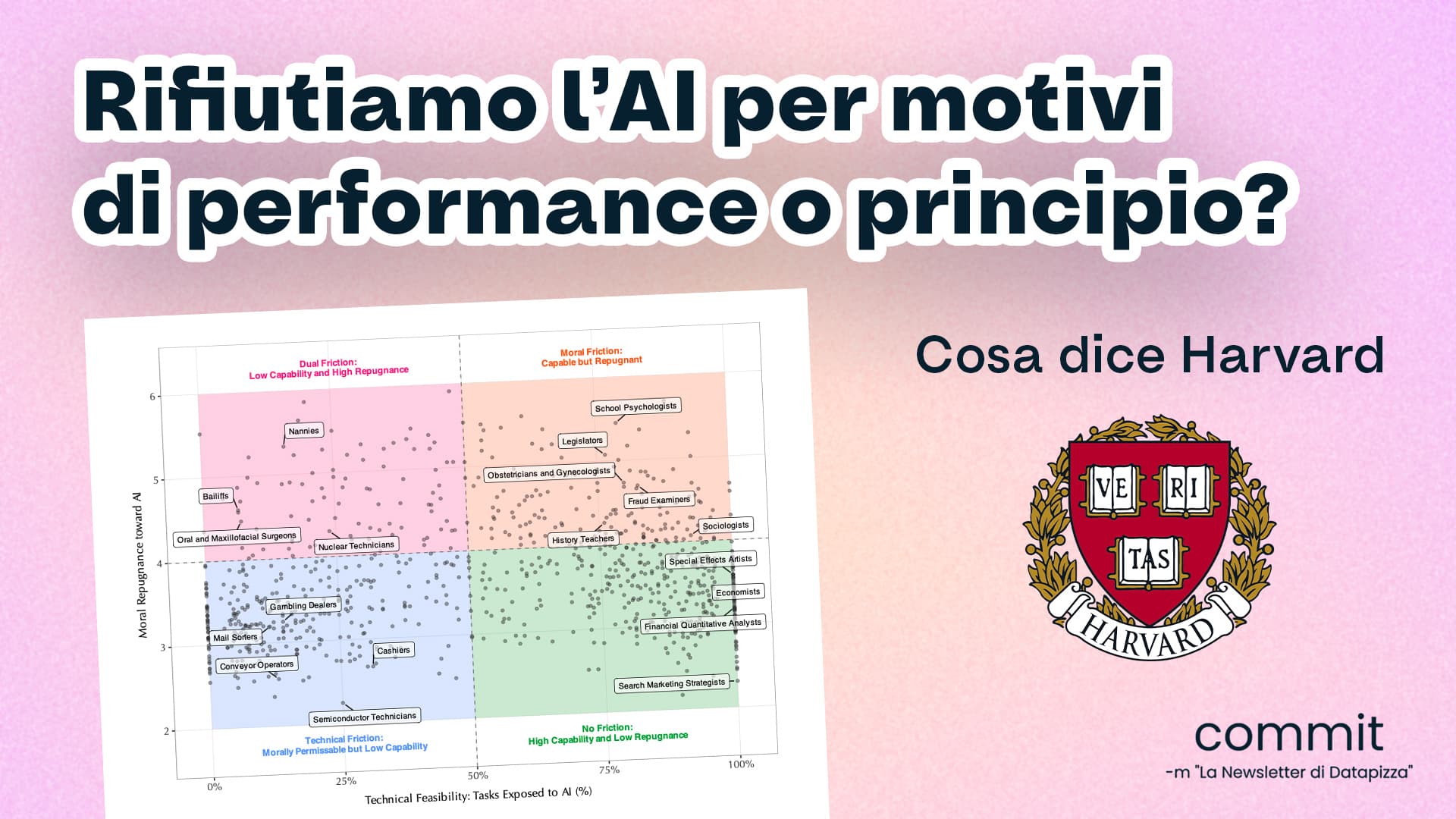

Rifiutiamo l'AI per motivi di performance o principio? Cosa dice Harvard

Uno studio di Harvard si è chiesto quali siano le principali resistenze all'AI nel proprio lavoro e sono uscite cose molto interessanti.