20/04/2026AI Act e regolamentazione: cosa sapere per chi lavora in azienda

Probabilmente ne hai sentito parlare. Forse ti è già capitato di pensare "me ne occuperò dopo", per poi rimandare. Il problema è che alcune parti dell'AI Act, il primo regolamento organico sull'Intelligenza Artificiale al mondo, sono già in vigore. E almeno una di esse riguarda quasi certamente il tuo business, indipendentemente dal ruolo che ricopri.

Questo articolo non è un manuale legale. È una guida per chiunque usi strumenti AI in contesto professionale e voglia capire, senza perdersi nel latinorum normativo, dove si trova e cosa deve fare.

Indice

- Cos'è l'AI Act e perché vale già in Italia

- L'applicazione progressiva

- La piramide del rischio

- Definizione di provider, deployer e operatore

- L'AI Literacy e l’obbligo di formazione

- AI Act e GDPR

- Il Digital Omnibus

- Cosa fare adesso

- Dual Checker: uno strumento per la compliance

1. Cos'è l'AI Act e perché vale già in Italia

L'AI Act è entrato in vigore il 1° agosto 2024. È un Regolamento Europeo - non una direttiva - e questa distinzione tecnica ha una conseguenza pratica immediata: non ha bisogno di essere recepito da una legge nazionale per essere applicabile. I giudici italiani possono già usarlo nelle cause legali.

La Legge 132/2025 non "attiva" l'AI Act in Italia, ma lo organizza:

- definisce quali autorità nazionali sono competenti (come l'ACN, l'Agenzia per la Cybersicurezza Nazionale)

- raccorda le regole AI con settori specifici come sanità e diritto del lavoro

- e introduce alcune figure di reato nuove, tra cui i deepfake.

Detto in modo brutalmente semplice: l’AI Act già riguarda le aziende. La legge italiana ha solo reso più ordinato il quadro interno.

A livello internazionale, il confronto è illuminante. Gli Stati Uniti non hanno ancora una legge federale sull'AI. Il Canada ha un proprio AIDA, ma focalizzato solo sui sistemi ad alto rischio. Il Regno Unito attende ancora un AI Bill. L'approccio europeo è diverso per impostazione: vuole tutelare i diritti fondamentali dei cittadini in modo trasversale, non solo in casi limite.

2. L'applicazione progressiva

Il legislatore sa che un regolamento di questa portata non si assorbe in una notte. Per questo l'AI Act ha un'applicazione a scaglioni. Le tappe principali:

- 1 agosto 2024 - Entrata in vigore ufficiale

- 2 febbraio 2025 - Divieti per i sistemi a rischio inaccettabile (manipolazione comportamentale, social scoring, identificazione biometrica remota in tempo reale) e obbligo di alfabetizzazione AI per tutto il personale aziendale

- 2 agosto 2025 - Norme per i modelli GPAI (come GPT, Claude, Gemini): trasparenza e rispetto del diritto d'autore

- 2 agosto 2026 - Norme per i sistemi ad alto rischio

- 2 agosto 2027 - Requisiti per i prodotti regolamentati (con possibile slittamento al 2 dicembre 2027, su cui è in corso una discussione al Consiglio Europeo)

La lezione pratica: le date slittano, ma l'obbligo di febbraio 2025 - la formazione - è già qui.

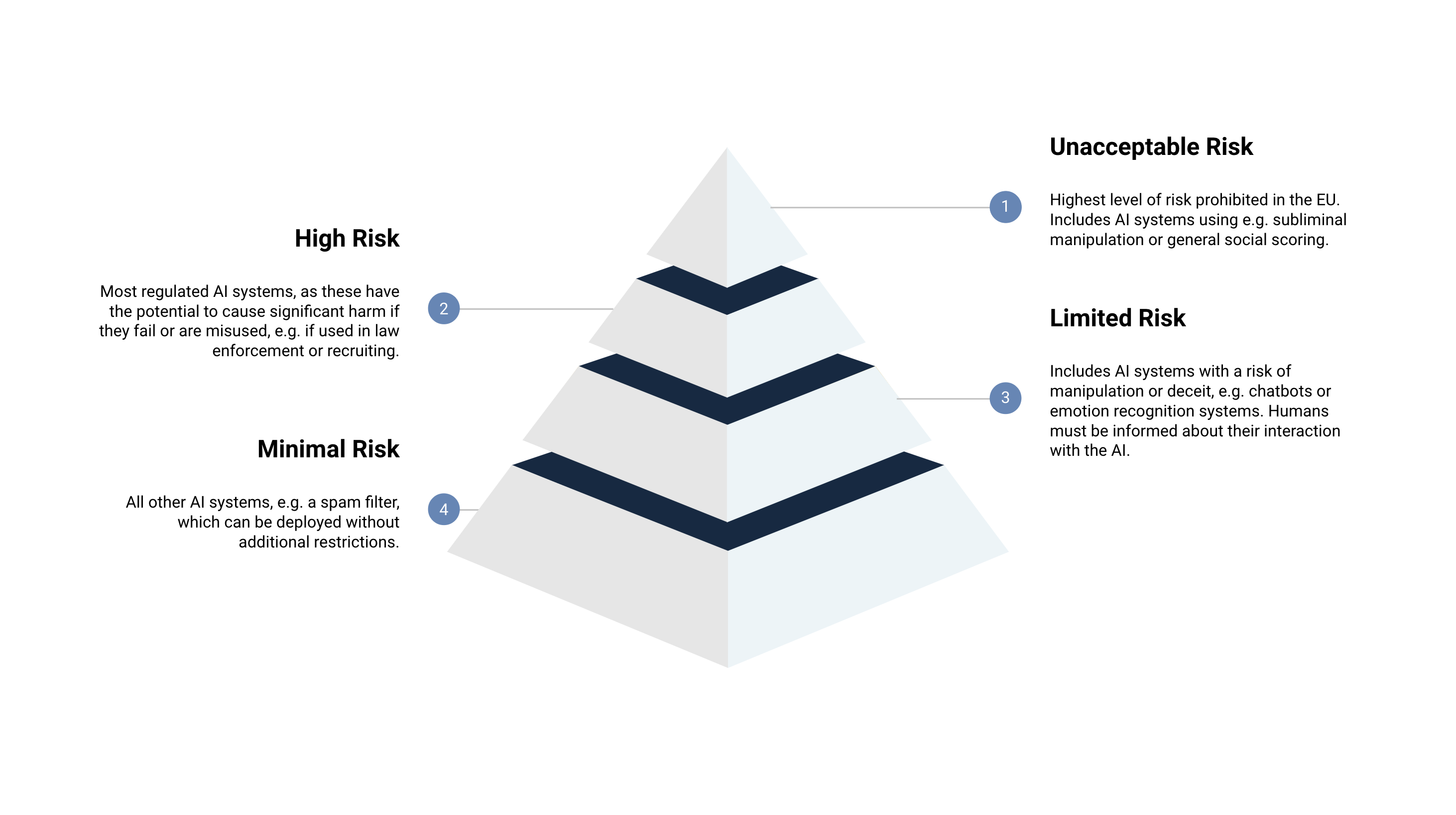

3. La piramide del rischio

L'AI Act classifica i sistemi AI in quattro livelli di rischio: inaccettabile, alto, trasparenza, minimo. Fin qui sembra semplice. Il punto che molti mancano è questo: non è il sistema in sé a determinare il livello di rischio, ma il contesto in cui viene usato.

Un sistema di riconoscimento del tono emotivo nel testo può avere requisiti di trasparenza modesti se usato per suggerire playlist musicali. Lo stesso sistema applicato a colloqui di lavoro o screening di candidature diventa potenzialmente ad alto rischio, perché può incidere su diritti fondamentali ad esempio l'accesso al lavoro.

Questo significa che non puoi delegare a qualcun altro la valutazione del rischio limitandoti a "è un tool che compra il vendor". Devi capire come lo usi tu, nel tuo contesto specifico.

4. Definizione di provider, deployer e operatore

L'AI Act usa tre termini tecnici in inglese e li usa intenzionalmente, per mantenerli precisi e non soggetti a derive traduttive:

- Provider: chi progetta e sviluppa il sistema AI. OpenAI, Google, Anthropic, un vendor qualsiasi.

- Deployer: chi adotta quel sistema all'interno di un'organizzazione. Se la tua azienda usa qualche strumento AI per il lavoro, qualcuno in azienda è il Deployer - e quella persona ha obblighi specifici.

- Operatore: termine ombrello che include entrambe le figure, più distributori e importatori. Serve a coprire i casi futuri che il legislatore non può ancora prevedere.

Il punto cruciale per le aziende: il Deployer ha un obbligo di due diligence sul Provider. Non basta scegliere uno strumento popolare. Bisogna verificare che il fornitore rispetti il diritto d'autore nei dati di addestramento (la Direttiva 2019/790 lo regola, e i provider devono essere trasparenti sull'opt-out dei titolari di opere), capire i termini di licenza dei contenuti generati, e assicurarsi che il provider fornisca documentazione adeguata sul funzionamento del sistema.

Questo ha implicazioni dirette: usare un provider non a norma senza le dovute verifiche comporta una diretta responsabilità aziendale (accountability).

Vale anche notare che l'AI Act si applica ai grandi provider esteri - OpenAI, Google, Microsoft, Anthropic - nel momento in cui operano entro il perimetro europeo. Non possono semplicemente ignorarlo perché hanno sede negli USA, ad esempio.

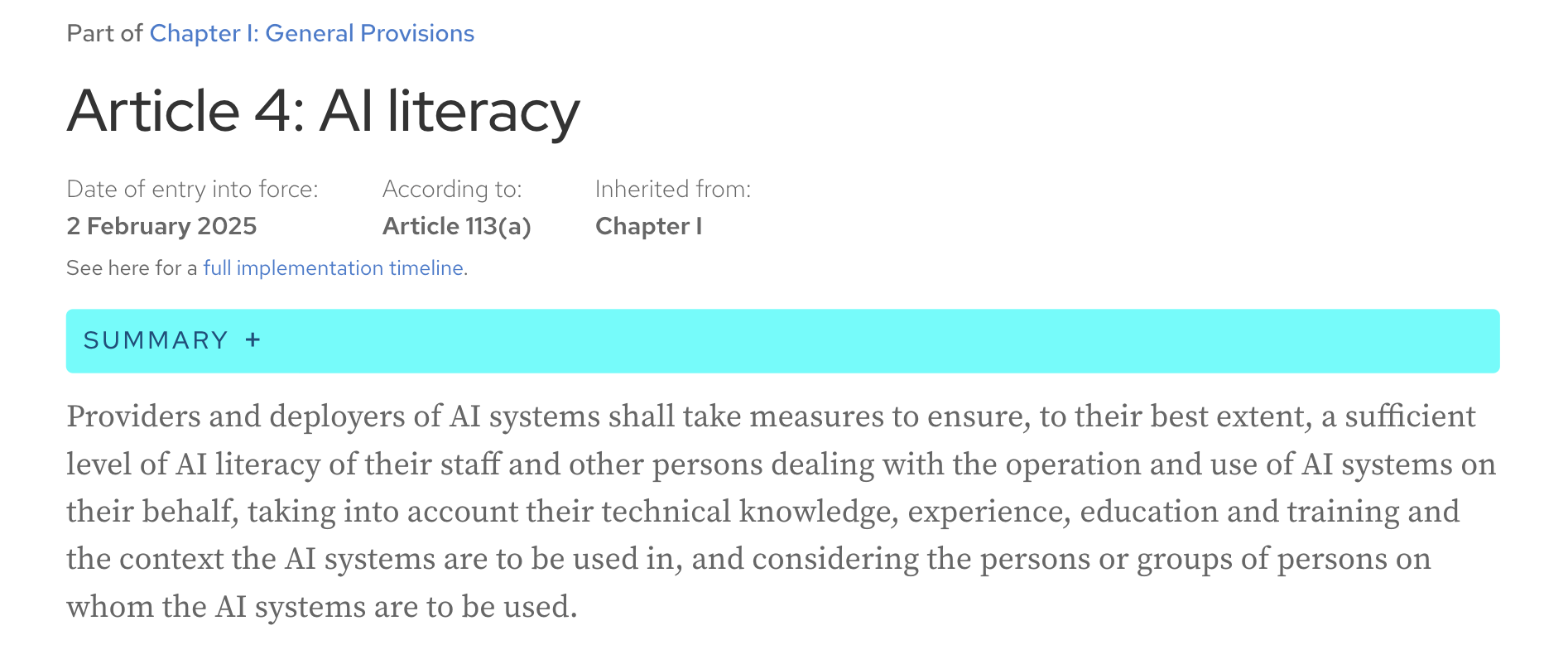

5. L’AI Literacy e l'obbligo di formazione

L'Articolo 4 introduce un obbligo che non dipende da calendari futuri o possibili slittamenti: tutto il personale che interagisce con sistemi AI deve avere un livello sufficiente di AI literacy, calibrato sul proprio ruolo.

Non si parla di un corso una tantum per il reparto IT. Si parla di formazione trasversale - dalla dirigenza alle figure operative - sugli strumenti AI effettivamente usati in quel contesto lavorativo. Il livello di competenza atteso varia in base alla complessità delle decisioni che quella persona può prendere grazie (o a causa) dell'AI.

Questo obbligo è già in vigore dal febbraio 2025. Chi non si è mosso è già fuori compliance.

6. AI Act e GDPR

Ci sembra necessario ribadire questo punto perché continua a generare confusione: il GDPR non è stato cancellato dall'AI Act. Le due normative regolano cose diverse e si integrano.

L'AI Act stabilisce come i sistemi AI devono essere progettati, documentati e messi in produzione. Il GDPR disciplina il trattamento dei dati personali - e questo vale anche quando quei dati finiscono in un prompt.

Un esempio concreto: se inserisci il curriculum di un candidato in ChatGPT per farne un riassunto, stai compiendo un trattamento di dati personali soggetto al GDPR. Il fatto che tu stia usando uno strumento AI non cambia nulla. Le aziende devono gestire le due compliance in modo integrato, non in silos separati.

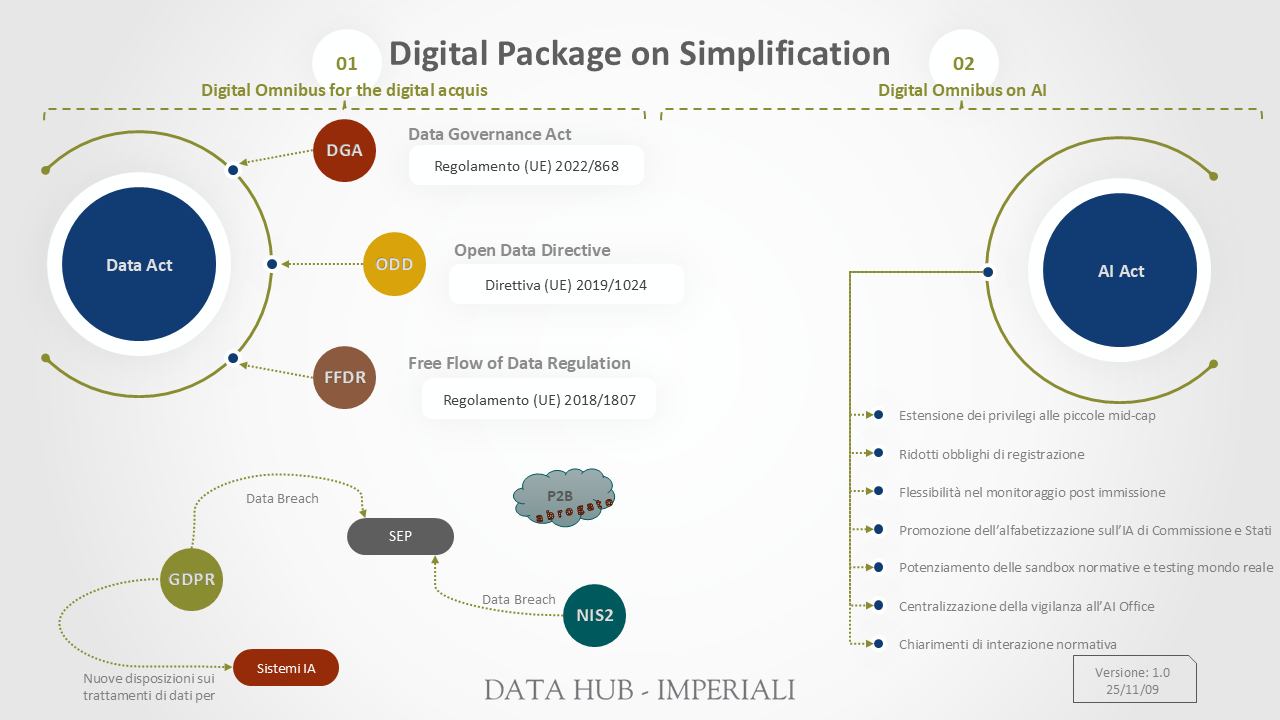

7. Il Digital Omnibus

A novembre 2025 la Commissione Europea ha presentato la Proposta Omnibus VII, un pacchetto di emendamenti che mira a semplificare e armonizzare la regolamentazione digitale europea. A marzo 2026 è stato raggiunto un accordo al Consiglio Europeo.

Il Digital Omnibus è la componente di questo pacchetto che tocca più direttamente l'AI e i dati. Le novità principali attese:

- semplificazione degli oneri normativi per le PMI;

- introduzione di regulatory sandbox - ambienti controllati dove le aziende possono sperimentare soluzioni AI con meno vincoli regolatori;

- possibilità di trattare dati sensibili per finalità specifiche di mitigazione dei bias algoritmici.

Attenzione: nulla di tutto questo è ancora definitivo. Come ogni processo normativo europeo, tra accordo politico e applicazione pratica ci sono ancora diversi passaggi. Vale la pena tenerlo sul radar senza trasformare le aspettative in piani operativi prematuri.

8. Cosa fare adesso

Il quadro normativo AI in Europa è complesso, dinamico e pieno di dettagli che cambiano prima che tu finisca di leggerli. Ma alcune cose sono già chiare e azionabili:

- Se sei un Deployer - cioè se la tua azienda usa strumenti AI - verifica che i provider scelti possano documentare trasparenza sull'addestramento e rispetto del diritto d'autore. Rivedi i termini di licenza.

- Se gestisci persone, assicurati che ci sia un piano di formazione AI calibrato sui ruoli, non un webinar generico. L'obbligo è già scattato.

- Se lavori in area legal o compliance, il GDPR e l'AI Act vanno presidiati insieme, con una vista integrata sui flussi di dati e sui sistemi in uso.

9. Dual Checker: uno strumento per la compliance

Leggere le norme è necessario, ma applicarle sistematicamente è complicato. Tuttavia, orientarsi in questo ginepraio normativo è possibile.

Infatti, chi lavora in ambito legal, compliance o procurement lo sa bene: la verifica documentale manuale è variabile per definizione. Dipende da chi la fa, in che momento, su quanti documenti ha già lavorato.

Due revisori esperti sullo stesso contratto trovano gap diversi, perché è nella natura della cognizione umana porre l’attenzione su criteri di valutazione o comparazione noti. Ciò che esula dal perimetro della propria esperienza non rientra nell'analisi.

È un limite strutturale del processo cognitivo umano e moltiplicare i revisori non risolve il problema, ma lo distribuisce.

Per questo in Datapizza abbiamo sviluppato Dual Checker, il modulo di Dual Intelligence - la suite di software AI di Datapizza - dedicato alla verifica di conformità su insiemi documentali complessi.

Funziona con un sistema multi-agente che applica i criteri definiti uno per uno, su ogni sezione rilevante, e restituisce una gap analysis strutturata con evidenze testuali: per ogni criterio sai se è presente, parzialmente presente o assente, con motivazione documentata e riferimento esatto alla sezione.

Il risparmio di tempo è misurabile - da ore a minuti per ogni contratto complesso. Ma la differenza più rilevante è un'altra: varianza zero. Stessi criteri, stesso metodo, stesso output, indipendentemente da chi verifica e quando.

Inoltre, è progettato per Legal, Procurement, Compliance, Risk e Sales, con deployment on-premise, ibrido o SaaS, audit trail completo e RBAC nativo.

Se ti occupi di compliance, scopri Dual Checker 👈

Se ti interessa approfondire a che punto siamo con la regolamentazione AI, ne abbiamo parlato in questa puntata di Algoritmi!

Simone Conversano - AI Transformation Specialist - Datapizza

Loredana Esposito - Senior AI Adoption Trainer - Datapizza

Irene Senatore - AI Adoption Specialist - Datapizza