09/04/2026Stiamo entrando nell’era della scarsità di AI?

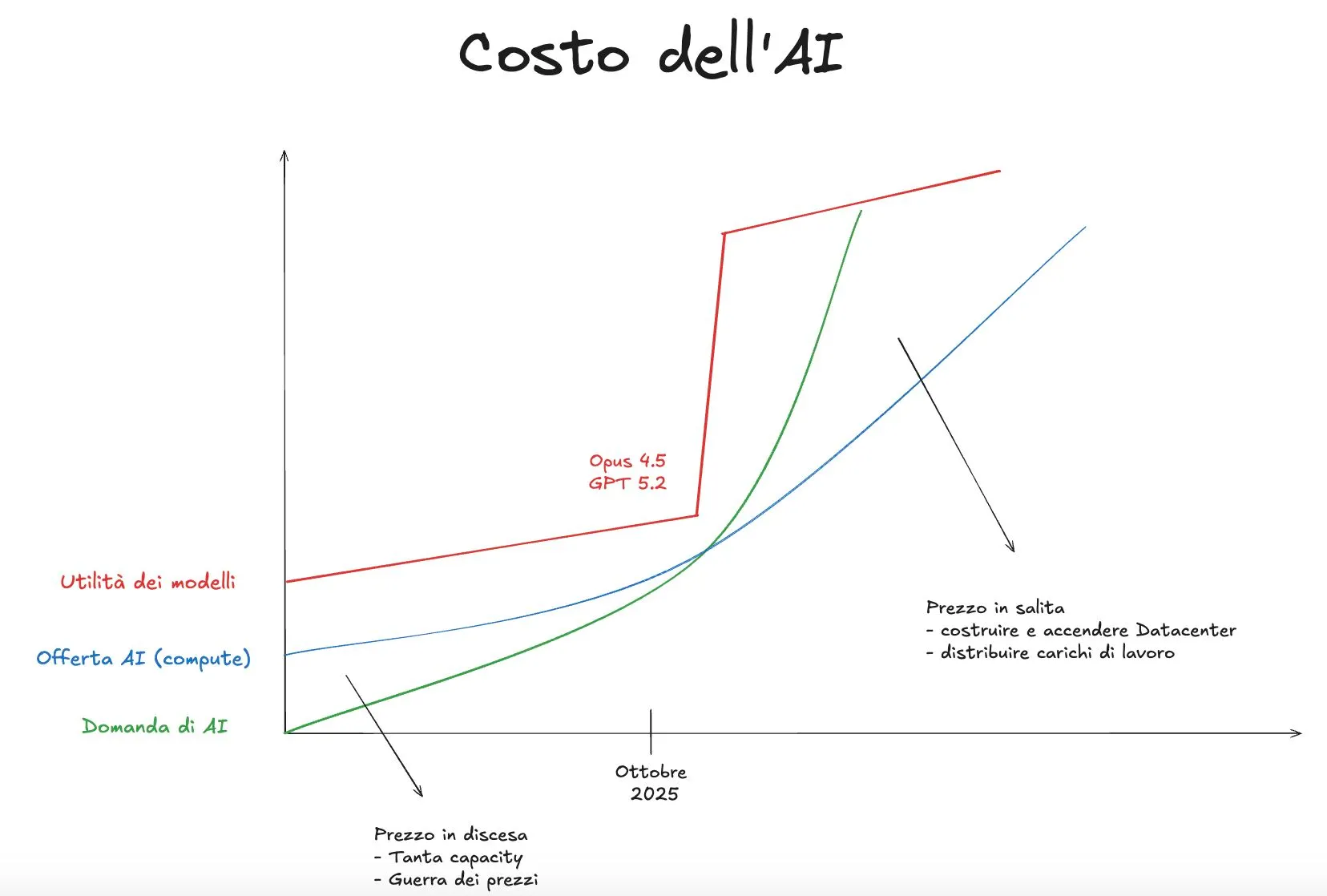

Negli ultimi due anni ci siamo abituati a una cosa strana: i prezzi dell'AI che scendono ad ogni nuovo rilascio.

Una cosa quasi paradossale, se ci pensi: tecnologia che migliora, ma costa meno.

Ma questo trend potrebbe essere sul punto di invertirsi.

E per capire perché, vale la pena fare un passo indietro di 160 anni.

Nel 1865, l'economista William Stanley Jevons ha osservato al miglioramento dell'efficienza delle macchine a vapore, il consumo di carbone non scendeva, ma esplodeva.

Perché? Perché l'efficienza abbassa il costo per unità di output, e questo espande la domanda ben oltre i guadagni di efficienza iniziali.

Ecco, il paradosso di Jevons vale anche per i token AI.

Negli ultimi due anni, il costo per token è sceso di circa 280 volte.

La reazione logica sarebbe: "ottimo, spendiamo meno."

Invece la spesa enterprise totale in AI è cresciuta del 320% nello stesso periodo.

Ma cosa sta succedendo al costo dei token?

Per capirlo, torniamo al meccanismo base.

Un LLM funziona prendendo l’input utente, convertendolo in token (pezzi di parole o segni grafici), facendoli elaborare da una GPU, e restituendo token in output all’utente.

Il costo di questa operazione dipende da variabili classiche: dimensione del modello, costo dell'energia, infrastruttura, e, ovviamente, quanto il mercato vuole quei token.

Ed è proprio quest’ultima variabile che sta cambiando tutto.

Fino al 2024, l'AI generativa è stata usata principalmente come chatbot avanzato: risposte a domande, sintesi di documenti, bozze di email, brainstorming…

Produttività individuale alta, sì, ma impatto limitato sui bilanci aziendali.

I modelli erano potenti, ma non abbastanza da gestire workflow complessi in autonomia.

Con i modelli più recenti (già da Opus 4.5 o GPT-5.2 dopo ottobre 2025), abbiamo visto un salto evolutivo.

Non siamo più nel territorio dei chatbot intelligenti: siamo nella fase in cui si possono delegare workflow lunghi, complessi e sfaccettati a sistemi che li portano a termine senza supervisione costante.

Chi lavora con aziende sull'adozione dell’AI lo vede già: i risultati, quando la configurazione è quella giusta, sono di un altro ordine di grandezza rispetto a prima.

Ma c'è un rovescio della medaglia che viene sottovalutato: l'effetto moltiplicativo che nessuno sta calcolando.

Gli agenti AI, cioè LLM che sono in grado di svolgere azioni in degli ambienti o usare dei tool, consumano token per ordini di grandezza superiori rispetto a un chatbot.

Un workflow complesso non è più semplicemente "manda un prompt, ricevi una risposta", ma un loop iterativo di chiamate, ragionamenti intermedi, correzioni, sotto-task.

I dati lo confermano: i workflow agentici generano mediamente 10-20 chiamate LLM per ogni singolo task utente e le architetture RAG gonfiano le finestre di contesto di 3-5 volte rispetto a un'interazione standard.

Nel caso dell'AI si sommano due componenti distinte:

- il classico effetto di sostituzione - faccio le stesse cose spendendo meno, quindi ne faccio molte di più

- più un effetto di espansione qualitativa - ovvero posso fare cose che prima erano semplicemente impraticabili

Il secondo termine è quello che rende l'accelerazione della domanda particolarmente ripida.

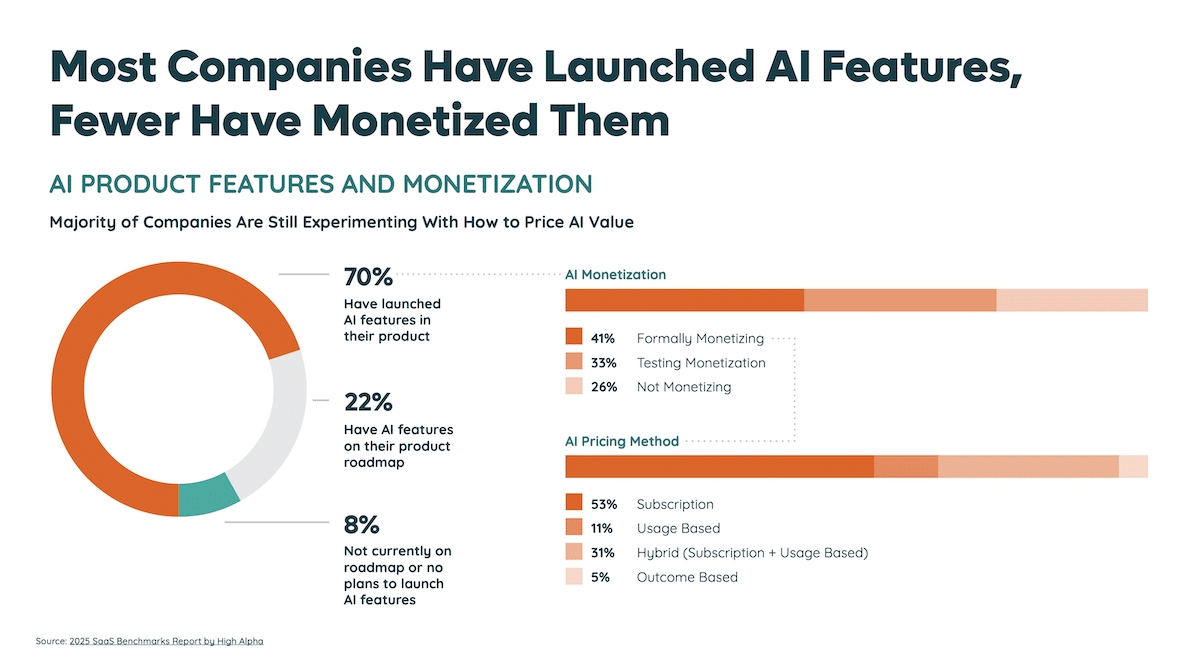

E i numeri lo confermano già.

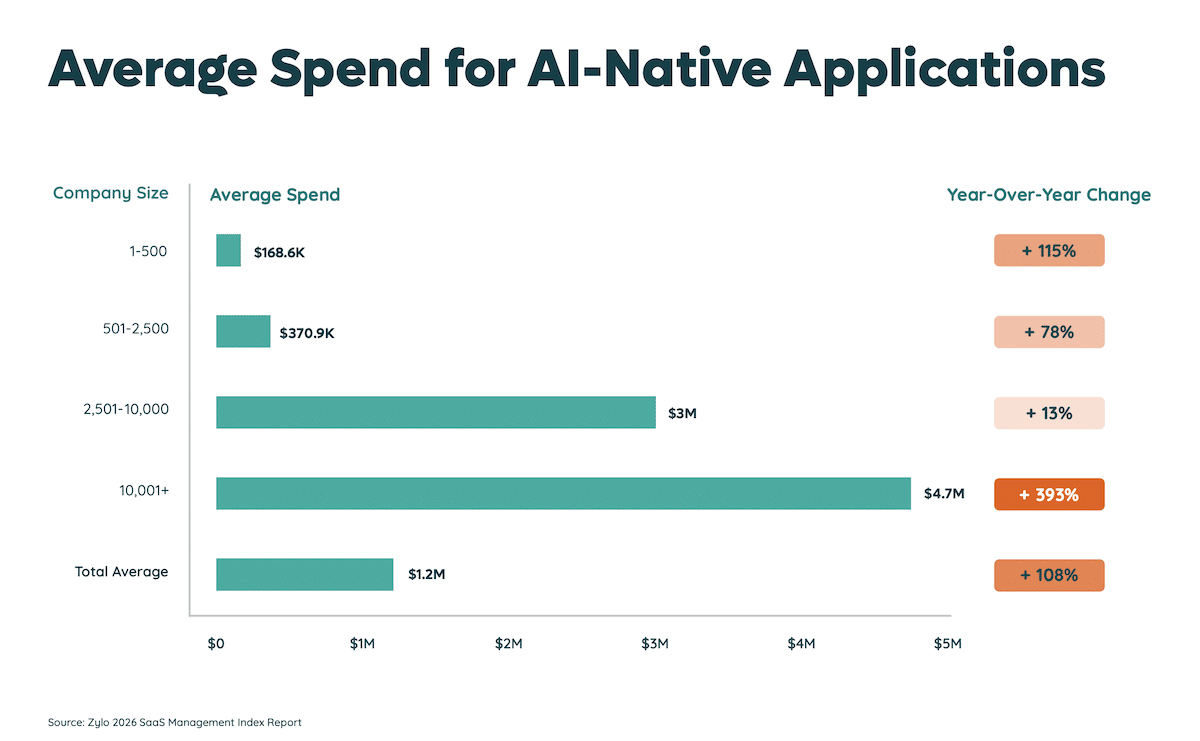

Le aziende non stanno solo usando più AI, ma stanno iniziando a trattare la potenza di calcolo come una risorsa strategica, aumentando i budget in modo significativo.

La spesa media enterprise in applicazioni AI-native ha raggiunto 1,2 milioni di dollari l'anno, con una crescita del 108% anno su anno.

E questo dato precede la diffusione degli agenti: quando i workflow agentici entreranno davvero in produzione su scala, il volume di token consumati per unità di valore creato crescerà ulteriormente.

Dal lato dell'offerta, i provider si stanno attrezzando di conseguenza: OpenAI ha impegnato oltre un trilione di dollari in infrastruttura hardware e cloud da qui al 2035.

Ma l’infrastruttura che si costruisce oggi richiede anni per entrare in produzione.

Nel mezzo, la finestra di potenziale scarsità.

Chi pensava di aspettare che i prezzi scendessero ancora sta scoprendo che la variabile rilevante non è il costo per token, ma il volume totale di token necessari per creare valore reale.

E quindi?

I segnali sono già visibili:

- Anthropic con problemi di disponibilità ricorrenti,

- prezzi notturni ridotti per spalmare il carico (proprio come succede con l'elettricità),

- grandi player che comprano blocchi di compute a lungo termine come se fossero commodity strategiche.

Potremmo aver vissuto una finestra breve e irripetibile di abbondanza di AI - compute economico, accesso facile, guerra dei prezzi tra provider…

Una fase in cui era conveniente sperimentare senza pensare troppo ai costi.

Quella finestra potrebbe chiudersi, portando a mercati più frammentati per area geografica, accesso privilegiato per chi ha comprato in anticipo e la possibilità concreta di strumenti finanziari legati alla compute AI.

Futures sui token? Se diventano un input critico per il core business di aziende quotate, è solo una questione di tempo.

Jevons lo aveva capito nel 1865 col carbone.

La domanda è se le aziende italiane lo capiranno adesso con i token, prima che la finestra si chiuda.

Giacomo Ciarlini - CIO - Datapizza

Simone Conversano - AI Adoption Specialist - Datapizza