02/04/2026Sapere quando non usare l’AI è una skill

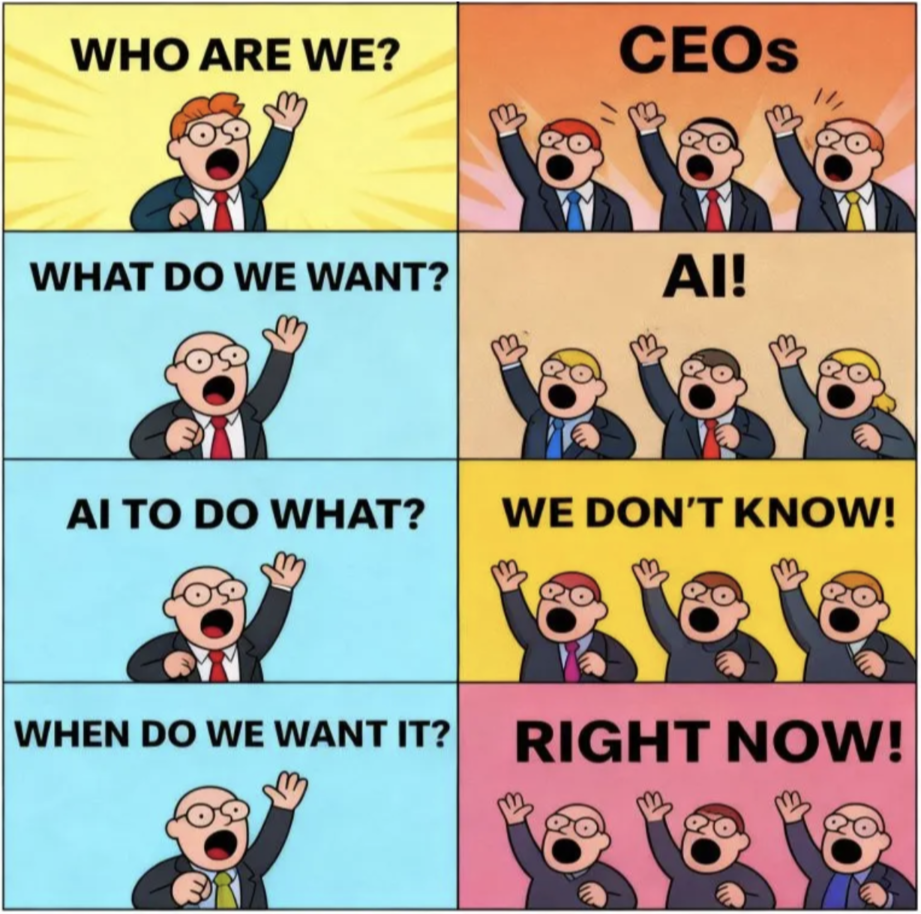

Qualche anno fa molti dicevano che la blockchain era la soluzione per ogni problema di business.

Non lo era. E no, non lo è neanche oggi l’AI. 😅

Negli ultimi anni, parlando di Generative AI, ho avuto spesso un senso di déjà-vu.

Stesso entusiasmo e stessa retorica del boom della blockchain: chi è nell’onda dell’hype vuole usare l’AI ovunque, a prescindere.

La tecnologia è diversa, l’impatto è più concreto, ma il riflesso rimane: se esiste un problema, allora c’è sicuramente un’AI che può risolverlo.

Il punto è che non sempre è vero.

E quasi nessuno è a suo agio nel dire “No. E ora ti spiego perché.”

Dire “sì” all’AI è diventato naturale.

Dire “no” richiede un livello di chiarezza, di responsabilità e di maturità che molte organizzazioni faticano ad avere.

Per esperienza diretta sul campo, posso dirti che questa esitazione si paga cara.

Perché è proprio quel “no” a fare la differenza tra adozione consapevole e accumulo di rischio.

(ne abbiamo parlato anche in live con Niccolò Rosini di GSK!)

Ma facciamo il nostro proverbiale passo indietro.

1️⃣ Quando il problema non è definito

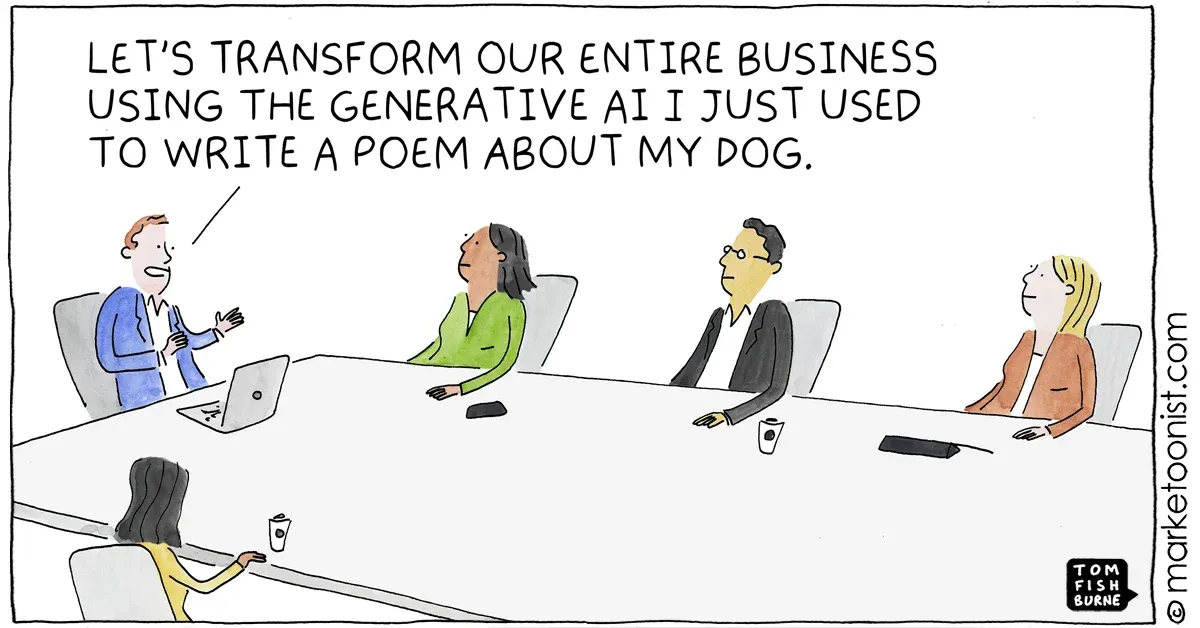

Il primo errore ricorrente è partire dalla tecnologia invece che dal problema.

Ho partecipato a decine di meeting iniziati così: “Usiamo/vogliamo usare la GenAI per migliorare l’efficienza.”

Efficienza di cosa?

Miglioramento per chi, esattamente?

E secondo quale metrica?

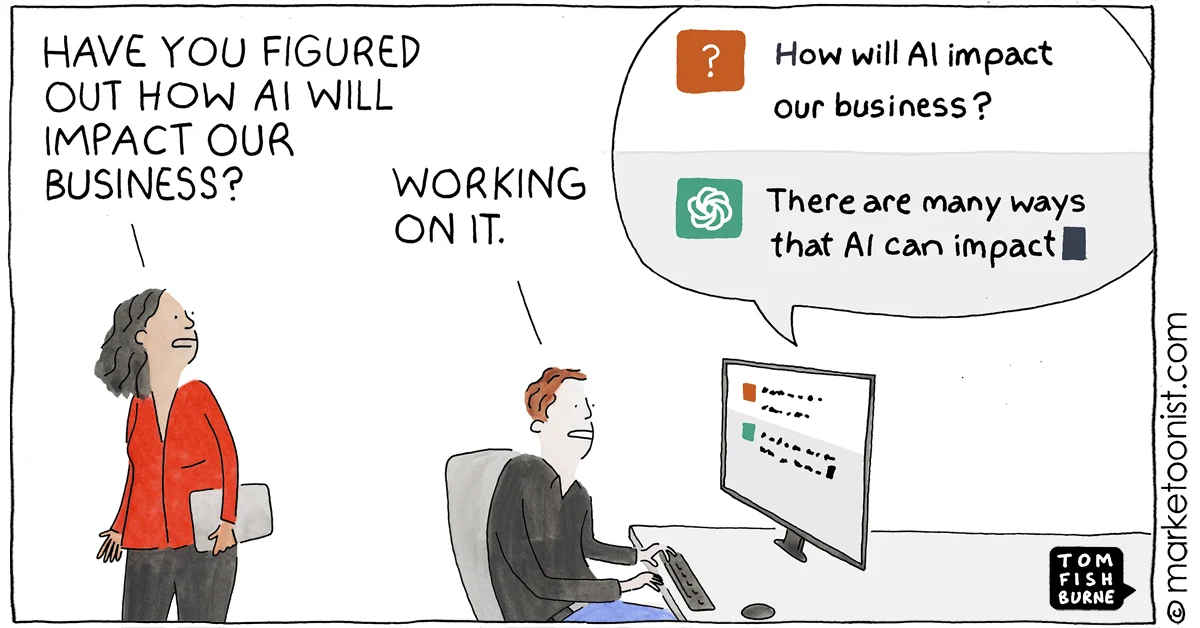

Ci sono team che passano settimane a discutere di Gemini vs Copilot vs ChatGPT vs Claude, fine-tuning vs prompting, token, contesto e limiti tecnici.

Prima che qualcuno sia in grado di rispondere a una domanda molto più semplice:

“Quale decisione o workflow stiamo davvero migliorando?”

Quando il problema non è chiaro e cambia forma ogni dieci minuti, la GenAI non chiarisce necessariamente il quadro.

Anzi, a volte addirittura amplifica la confusione, perché produce output convincenti su domande sbagliate.

Trasforma l’ambiguità in risposte plausibili, ben scritte, ben formattate… e completamente inutili, che spesso ti allontanano dalla soluzione ideale.

Una regola pratica che nel tempo ho trovato utile è questa:

👉 se il problema non può essere scritto in una frase semplice e chiara, la discussione sull’AI è prematura.

Prima si chiarisce il contesto, e poi, forse, si parla di tool e automazione.

Altrimenti si rischia di riporre aspettative sbagliate nella tecnologia, rimanendo delusi dall’adozione e bruciando investimenti.

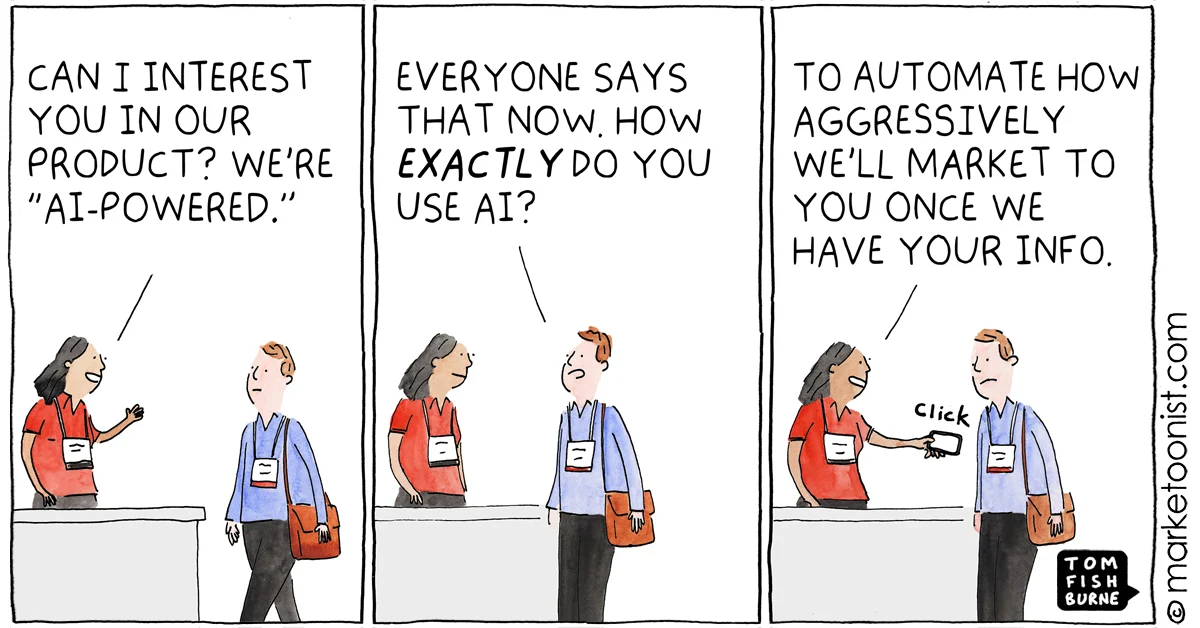

2️⃣ Trattare la GenAI come una feature

A livello enterprise, molti progetti di GenAI funzionano benissimo nelle demo: UI pulita, risposte rapide, tono sicuro.

Il problema è quello che non si vede:

- chi è responsabile dei dati?

- come vengono aggiornati?

- cosa succede quando il modello sbaglia?

- chi se ne accorge?

- chi decide cosa fare dopo?

Quando l’AI viene trattata come una feature invece che come un approccio, manca tutto ciò che rende il sistema affidabile nel tempo: responsabilità, processi, gestione dei fallimenti.

In questi casi l’AI non accelera il valore: accelera l’esposizione al rischio.

3️⃣ Contesti ad alta criticità

Esistono decisioni in cui l’accuratezza non è negoziabile.

Non “tanto poi correggiamo” o “lo controlliamo dopo”.

Parlo di casi in cui un errore è dannoso per definizione: interpretazioni normative, decisioni finanziarie, valutazioni legali, certificazioni di compliance…

Qui il tema non è se l’AI “funziona”, ma se esiste o meno un ciclo di verifica solido, esplicito e responsabile.

In assenza di un controllo chiaro, l’uso sensato della GenAI è di supporto - analisi, sintesi, esplorazione - ma non di decisione o finalizzazione.

In breve: l’AI assiste e suggerisce, non decide.

Chi non accetta questo confine, di solito non sta delegando lavoro, ma accountability.

Con l’AI nei processi, invece, è fondamentale lo human-in-the-loop: rimanere presenti e partecipi dell’output o degli step di un’automazione, e validarli sempre prima di prendere una decisione.

4️⃣ Usare l’AI per compensare problemi organizzativi

Il quarto errore tipico è più strutturale ed è forse il più sottovalutato: processi mal definiti, responsabilità ambigue, colli di bottiglia decisionali, incentivi disallineati.

Tutto questo è un problema a monte che l’AI non risolve.

Piuttosto, a volte lo scala.

Se un processo è inefficiente quando è manuale, credi che non lo sarà anche quando sarà assistito o automatizzato da un modello? 🫠

Per questo l’ordine conta: prima si sistema il processo, poi si valuta se l’AI può migliorarlo e dove ha senso integrarla.

Invertire la sequenza è un ottimo modo per costruire debito operativo e accelerare la disfunzionalità del processo.

5️⃣ Dare troppo contesto all’AI

Questo, detto sinceramente, all’inizio mi ha sorpreso!

Molti team partono da un’assunzione intuitiva: più contesto = risposte migliori.

Vero, ma…

Spesso ho visto risposte diluite, ragionamenti incoerenti e perdita di rilevanza.

L’AI non migliora automaticamente con più dati. Migliora con un contesto chiaro, curato e affidabile.

🚀 Cosa è cambiato per me

Lavorando con la GenAI nelle aziende, ho capito che anche sapere quando non usarla è una skill.

Oggi sono molto meno impressionato da demo, benchmark ed entusiasmo iniziale, e molto più attento a chiarezza decisionale, ownership operativa, maturità della governance e fiducia nel lungo periodo.

Col tempo, saper dire “no” mi ha portato a un approccio meno rumoroso e più efficace:

- meno casi d’uso, scelti meglio

- adozione più graduale, ma consapevole e intenzionale

- confini chiari su dove l’AI non deve stare

E oggi, prima ancora di chiedermi “possiamo usare la GenAI?”, mi faccio sempre un’altra domanda:

👉 se questo modello producesse un output sbagliato o pericoloso, ce ne accorgeremmo subito? E sapremmo cosa fare dopo?

Se la risposta è vaga o incerta, probabilmente il problema non è tecnologico… e non è l’AI la soluzione.

Quindi, un consiglio pratico per CIO e leadership tech: prima di rendere i team “AI-powered”, rendi i dati AI-ready.

Scegli un dominio critico (finance, supply chain, customer ops) e sistema il percorso end-to-end: ownership, definizioni, accessi.

Poi esponi gli stessi dati governati all’AI per fare ricerca, sintesi, ragionamento.

La produttività non nasce solo da prompt migliori, ma anche da un’infrastruttura affidabile, organizzata e robusta.

E la governance risolta a livello dati scala su ogni caso d’uso dell’AI.

Insomma: dire “sì” è facile, dire “no” è leadership.

E l’innovazione non è dire sempre “sì”. A volte è saper dire “non ancora”. 👀

👉 Se sei interessato/a al nostro approccio all’AI Adoption, dai un’occhiata ai nostri percorsi!

Giacomo Ciarlini - CIO - Datapizza

Simone Conversano - AI Adoption Specialist - Datapizza