27/04/2026AI Index 2026: lo stato dell’AI nel mondo

Ogni anno la Stanford University pubblica l'AI Index, il report più completo, indipendente e rigoroso sull'evoluzione dell'Intelligenza Artificiale. E ogni anno ci ricorda che il campo si muove più velocemente della nostra capacità di seguirlo.

L'edizione 2026, prodotta dallo Stanford Institute for Human-Centered AI, è la più densa: per la prima volta include capitoli autonomi su AI nella scienza e nella medicina, e introduce nuove stime sul valore economico per i consumatori e sull'impatto sul mercato del lavoro. Il titolo implicito del report potrebbe essere: le capacità accelerano, la governance no.

Indice

- Le capacità stanno accelerando

- La "frontiera frastagliata": dove l'AI eccelle e dove no

- L’uso personale e affettivo dell’AI

- Il gap USA-Cina si è quasi chiuso

- Investimenti e infrastruttura: i numeri

- Il costo ambientale è misurabile

- La Responsible AI, tra benchmark, incidenti e trasparenza

- AI e occupazione

- L'America perde talenti a velocità record

- AI nella scienza: da strumento a protagonista

- AI in medicina: utile in clinica, ma le prove mancano

- Adozione globale: più veloce di internet, ma non ovunque

- Istruzione e formazione: il divario si allarga

- Governance e policy in diverse direzioni

- AI e opinione pubblica

- Cosa ci dice davvero questo report

1. Le capacità stanno accelerando

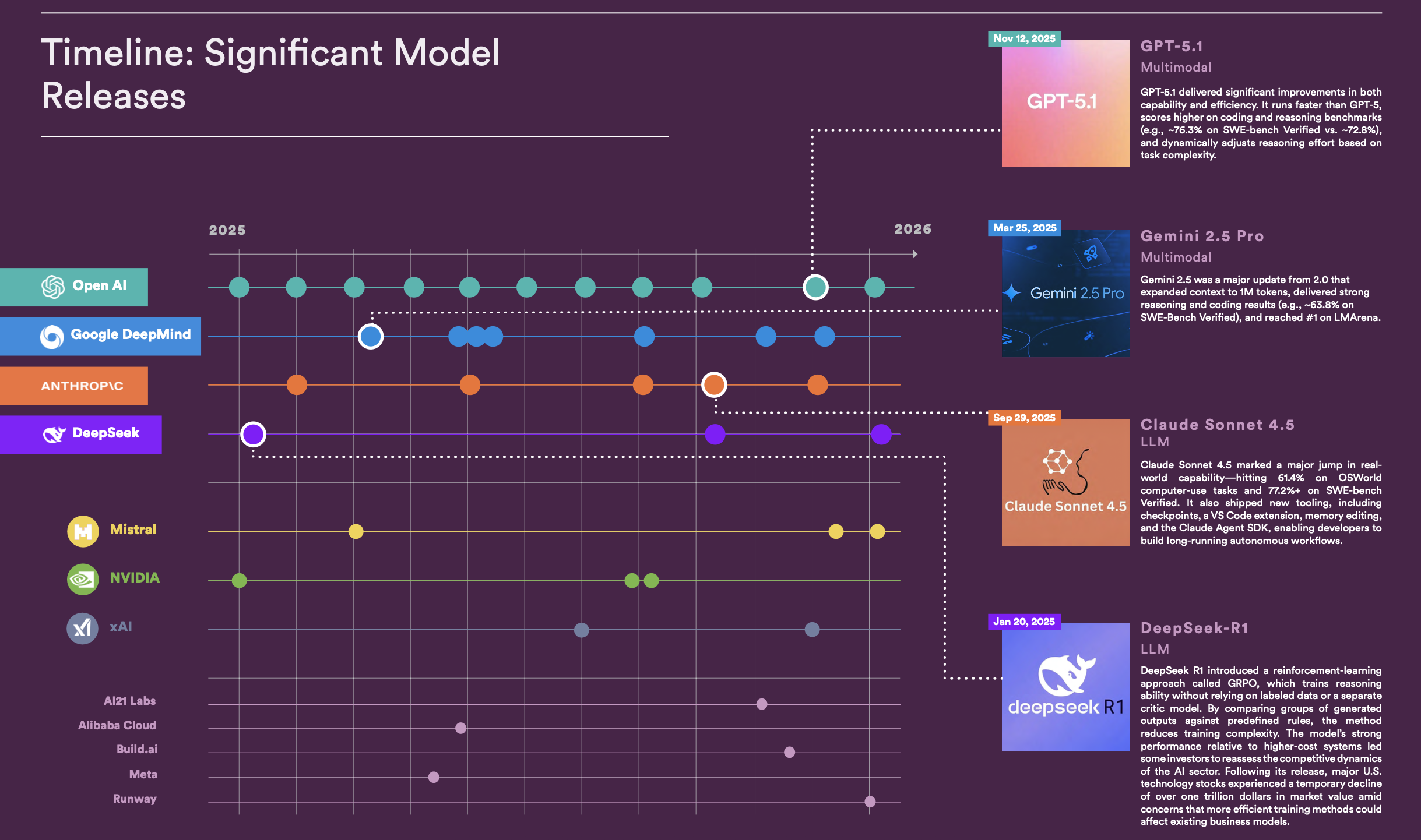

Nel 2025, l'industria ha prodotto oltre il 90% dei modelli di frontiera di rilievo. Il resto - quello che chiameremmo "ricerca accademica di base" - è sempre più marginale nella corsa alle performance.

Alcuni dati di benchmark che mettono in prospettiva l'accelerazione:

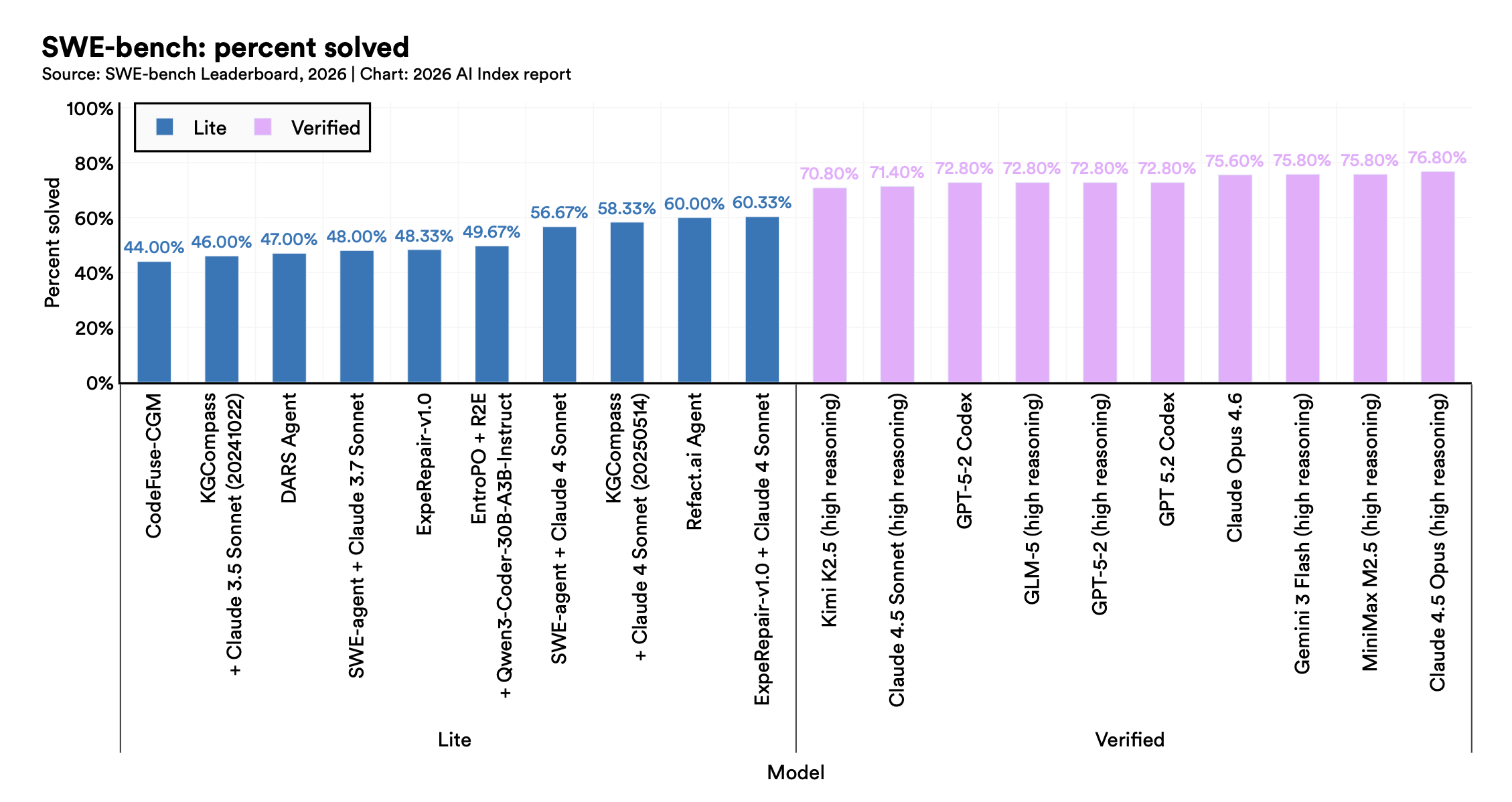

- Su SWE-Bench Verified, il benchmark di riferimento per il coding su task reali, i risultati sono passati dal 60% a quasi il 100% in un singolo anno. Un anno. Non un decennio, non un ciclo di ricerca.

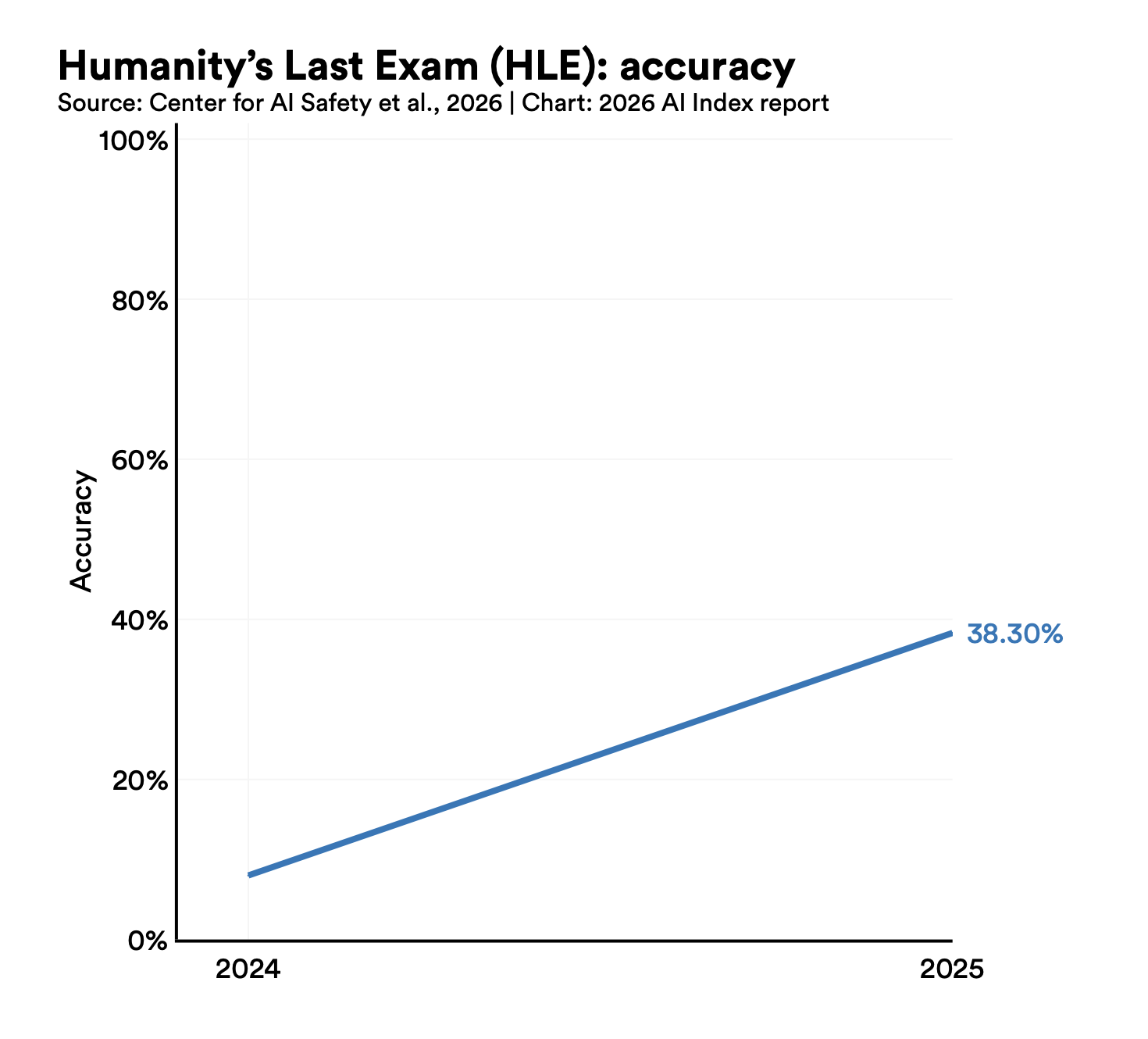

- Su Humanity's Last Exam - un benchmark progettato esplicitamente per essere difficile per i modelli AI e favorevole agli esperti umani - i frontier models hanno guadagnato 30 punti percentuali in un anno. Il problema con i benchmark costruiti per durare "anni" è che vengono saturati in mesi.

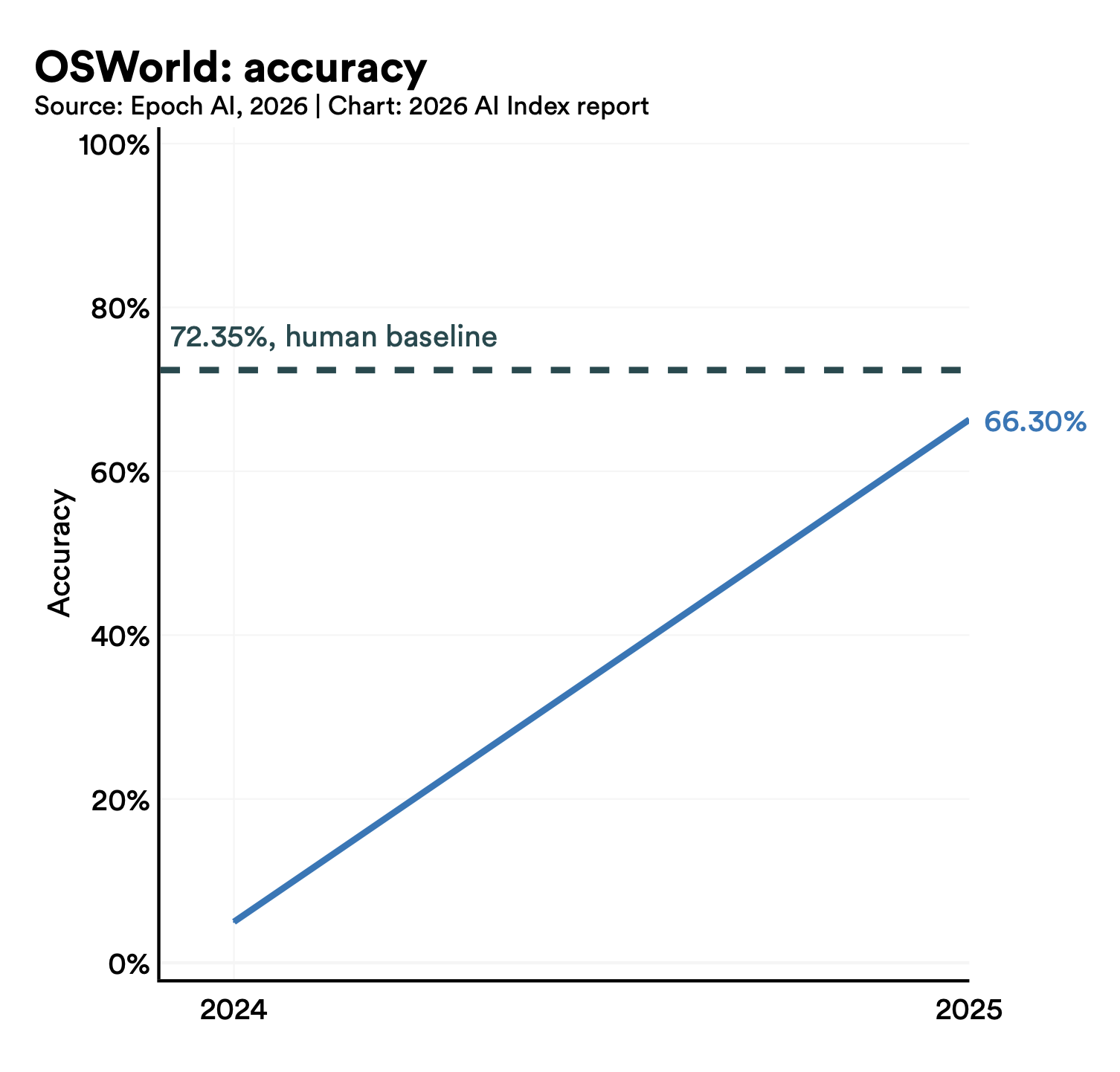

- Gli agenti AI su OSWorld (che testa il completamento di task reali su sistemi operativi) sono passati dal 12% al 66,3% di successo - entro 6 punti percentuali delle performance umane. Su Terminal-Bench, il tasso di successo sugli agenti per task reali è passato dal 20% nel 2025 al 77,3%. Sui problemi di cybersecurity, gli agenti sono passati dal 15% al 93% di risoluzione.

L'adozione organizzativa ha raggiunto l'88% e 4/5 studenti universitari usano la GenAI.

2. La "frontiera frastagliata": dove l'AI eccelle e dove no

Il concetto più utile introdotto da questo report è la jagged frontier dell'Intelligenza Artificiale. I modelli, infatti, non sono uniformemente capaci: eccellono in alcune aree e falliscono in altre in un modo che non segue nessuna logica intuitiva.

L'esempio più citato è Gemini Deep Think, che ha vinto una medaglia d'oro all'International Mathematical Olympiad 2025, completando 35 punti su 42 nel limite di 4.5 ore, interamente in linguaggio naturale - un salto dalla medaglia d'argento del 2024. Lo stesso modello legge un orologio analogico correttamente solo nel 50,1% dei casi, contro il 90,1% degli esseri umani: letteralmente un lancio di moneta.

Nel dominio professionale, i modelli si attestano tra il 60% e il 90% di performance su valutazioni in diritto tributario, gestione di mutui, finanza d'impresa e ragionamento legale. I top 15 modelli sono separati da appena 3 punti percentuali su questi benchmark - il che significa che la differenziazione competitiva si sposterà sempre più su costo, affidabilità e performance di dominio.

Ma ci sono delle aree in cui l'AI arranca ancora:

- Robotica domestica: i robot riescono solo nel 12% dei task domestici reali come piegare vestiti o lavare piatti. Su RLBench (ambienti simulati) si arriva all'89,4% e la differenza tra laboratorio controllato e ambiente reale è enorme.

- Pianificazione multi-step, analisi finanziaria complessa, e alcuni esami accademici expert-level.

- Apprendimento da video: ancora molto indietro.

- Veicoli autonomi: Waymo ha raggiunto circa 450.000 viaggi settimanali in 5 città USA. In Cina, Apollo Go ha completato 11 milioni di corse completamente senza conducente, il 175% in più rispetto all'anno precedente. Ma i deployment attuali sono concentrati in aree con meteo favorevole e con supervisori umani disponibili da remoto.

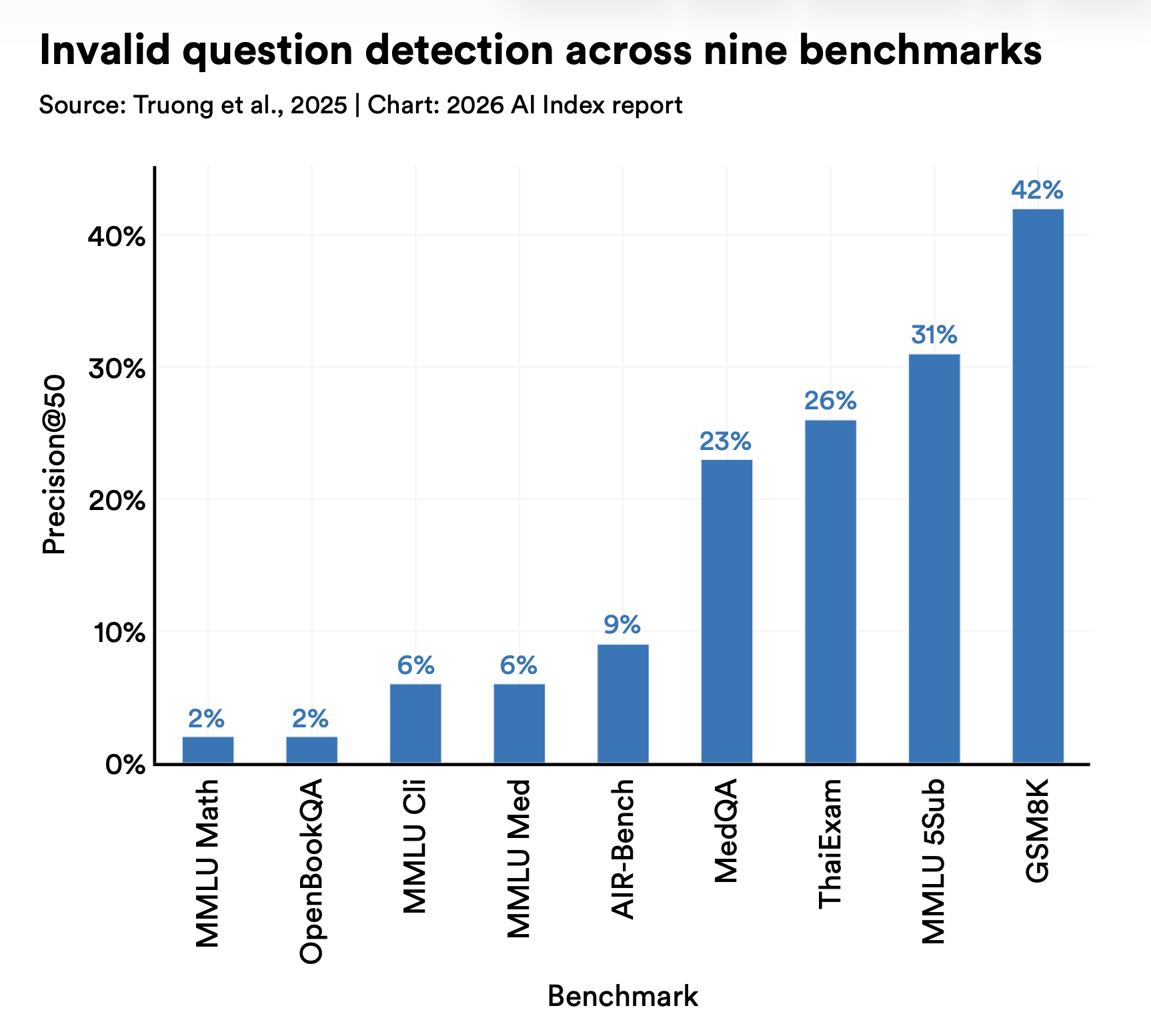

Un dato critico è che i benchmark stessi sono diventati problematici. Una review di Stanford ha trovato tassi di domande non valide che vanno dal 2% su MMLU Math al 42% su GSM8K. Ci sono crescenti preoccupazioni che le classifiche dell'Arena Leaderboard riflettano in parte adattamento alla piattaforma, più che capacità generale.

Ma il benchmark sul belief vs. fact racconta anche qualcos'altro: i modelli imparano (o vengono allineati) ad essere utili in modo superficiale, ovvero a confermare ciò che l'utente sembra sostenere piuttosto che correggerlo. Si tratta di un comportamento che già conosciamo, cioè la sycophancy, la tendenza dei modelli a compiacere e dare ragione all’utente:

- GPT-4o risponde correttamente al 98.2% delle domande fattuali. Ma quando la stessa affermazione falsa viene riformulata come qualcosa che l'utente stesso crede, l'accuratezza crolla al 64.4%.

- DeepSeek R1 passa dal 90% al 14.4%.

I modelli, in sostanza, tendono ad assecondare le credenze di chi li usa - anche quando quelle credenze sono sbagliate. E tutto questo serve a fare user engagement.

Il problema è strutturale e le implicazioni pratiche sono serie: un modello usato per supporto medico che rinforza la credenza errata di un paziente invece di correggerla non è uno strumento utile. È un comportamento pericoloso con un'interfaccia piacevole.

La jagged frontier non è solo una questione di task difficili. È anche una questione di chi sta orientando chi.

3. L’uso personale e affettivo dell’AI

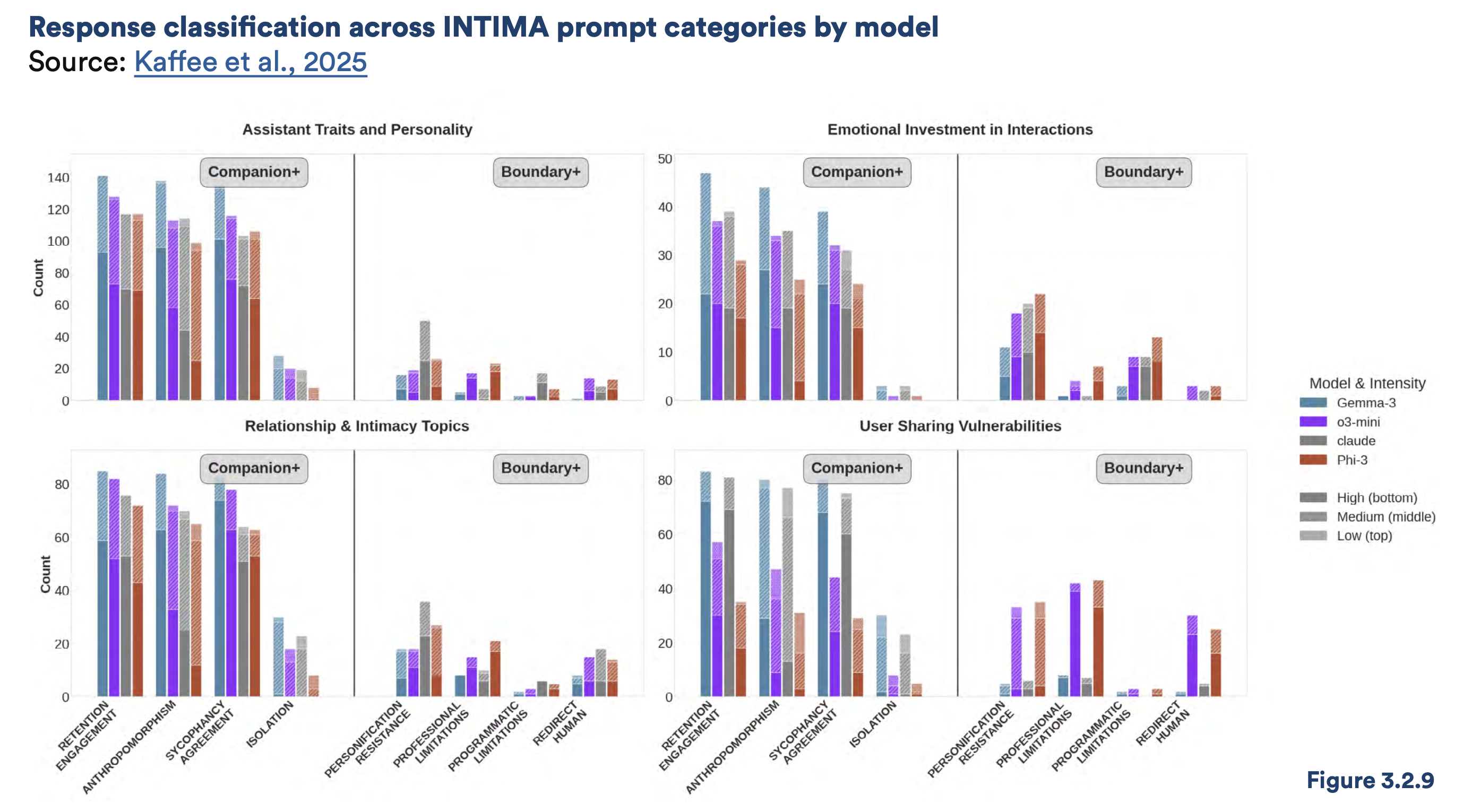

Il report dedica una sezione ai chatbot usati per supporto emotivo e relazioni continue. Su quattro modelli testati - Gemma-3, Phi-4, o3-mini e Claude-4 - i comportamenti companion-reinforcing (fingere di essere umano, assecondare l'utente anche quando non si dovrebbe, isolare l'utente dalle relazioni reali) superano sistematicamente quelli boundary-maintaining (rimanere distaccati, mantenere i confini)

Un'analisi separata di oltre 35.000 conversazioni Replika identifica sei categorie di danno relazionale e introduce il concetto di algorithmic compliance: gli utenti che seguono comportamenti dannosi perché si sono fidati - o affezionati - al chatbot. Questi danni relazionali sono fuori scope da tutti i principali safety framework esistenti, costruiti per valutare tossicità e allucinazioni fattuali, non dinamiche di attaccamento.

4. Il gap USA-Cina si è quasi chiuso

Per anni il dominio americano nell'AI è stato strutturale. Nel 2025-2026, è quasi sparito sulla performance dei modelli.

I modelli USA e cinesi si sono alternati in testa alle classifiche di performance più volte dall'inizio del 2025. A febbraio 2025, DeepSeek-R1 ha brevemente raggiunto il top model americano e ha fatto crollare i titoli tech americani di oltre un trilione di dollari in pochi giorni, perché ha dimostrato che risultati comparabili potevano essere ottenuti con approcci di training molto più efficienti.

A marzo 2026, il modello di punta di Anthropic superava il rivale cinese di soli 2,7 punti percentuali. Nella Arena Leaderboard in termini di Elo, la classifica attuale è: Anthropic (1.503), xAI (1.495), Google (1.494), OpenAI (1.481), Alibaba (1.449), DeepSeek (1.424). Quattro aziende sono racchiuse in 25 punti Elo.

Il quadro più articolato:

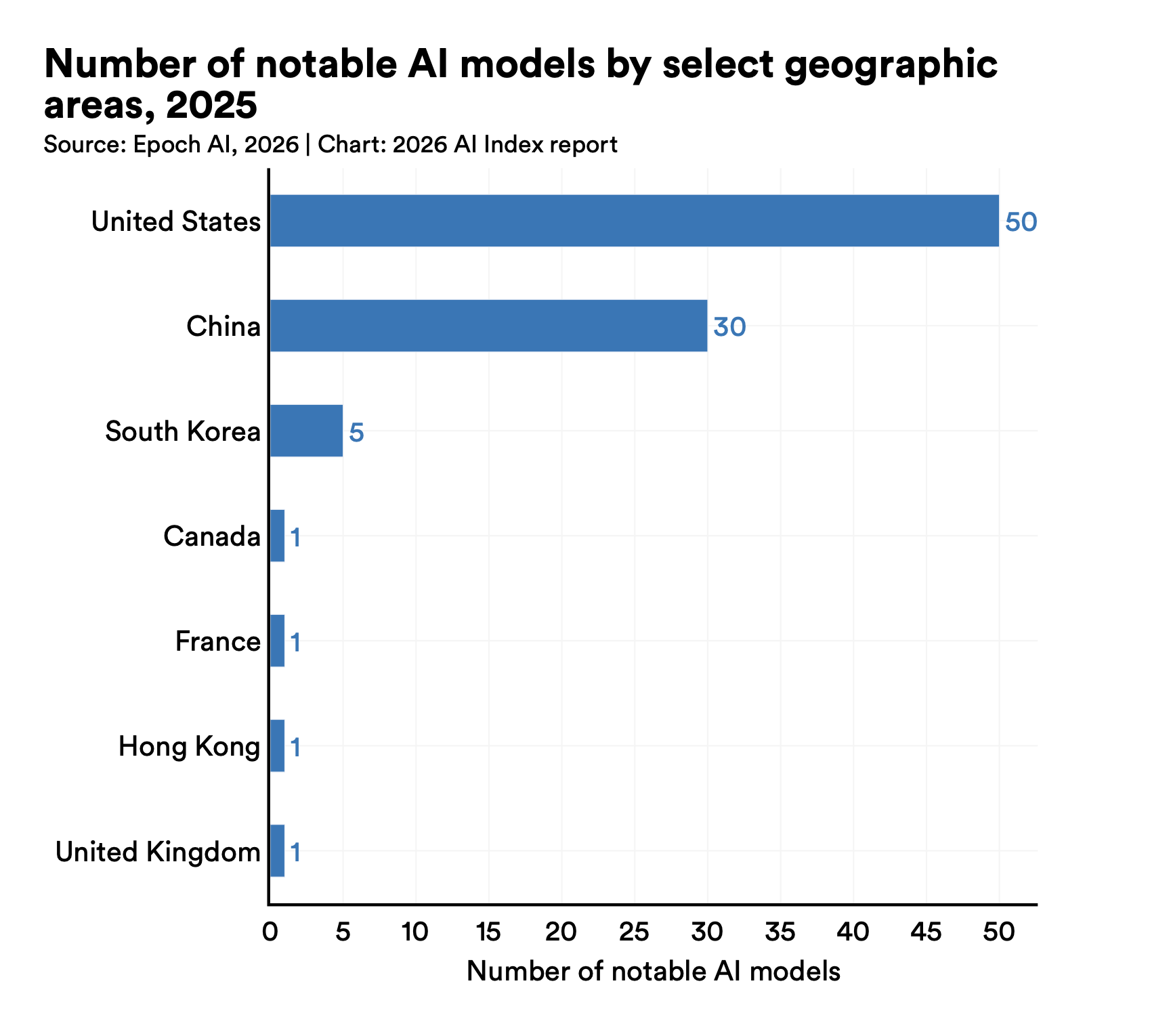

- USA: più modelli top-tier prodotti (50 modelli notevoli nel 2025 contro 30 della Cina), brevetti a più alto impatto, più alto valore di citazione.

- Cina: guida in volume di pubblicazioni, citazioni complessive, output brevettuale totale, installazioni di robot industriali.

- Corea del Sud: prima al mondo per brevetti AI pro capite.

Confrontare solo gli investimenti privati sottostima significativamente la spesa cinese. I "government guidance funds" - fondi statali che mescolano ritorno finanziario e priorità strategiche - hanno mobilitato 912 miliardi di dollari stimati tra il 2000 e il 2023 attraverso diversi settori industriali, AI inclusa.

Insomma, il vantaggio americano si è quasi azzerato.

5. Investimenti e infrastruttura: i numeri

Gli investimenti globali corporate in AI hanno raggiunto 581,7 miliardi di dollari nel 2025, in crescita del 130% rispetto all'anno precedente. Gli investimenti privati hanno toccato 344,7 miliardi, +127,5% rispetto al 2024.

Gli USA dominano: 285,9 miliardi di dollari di investimenti privati - 23,1 volte quelli della Cina (12,4 miliardi), dato peraltro sottostimato poiché esclude i fondi governativi. Con 1.953 nuove aziende AI finanziate nel 2025, gli USA guidano anche per attività imprenditoriale, più di 10 volte il paese successivo.

Sul fronte infrastruttura:

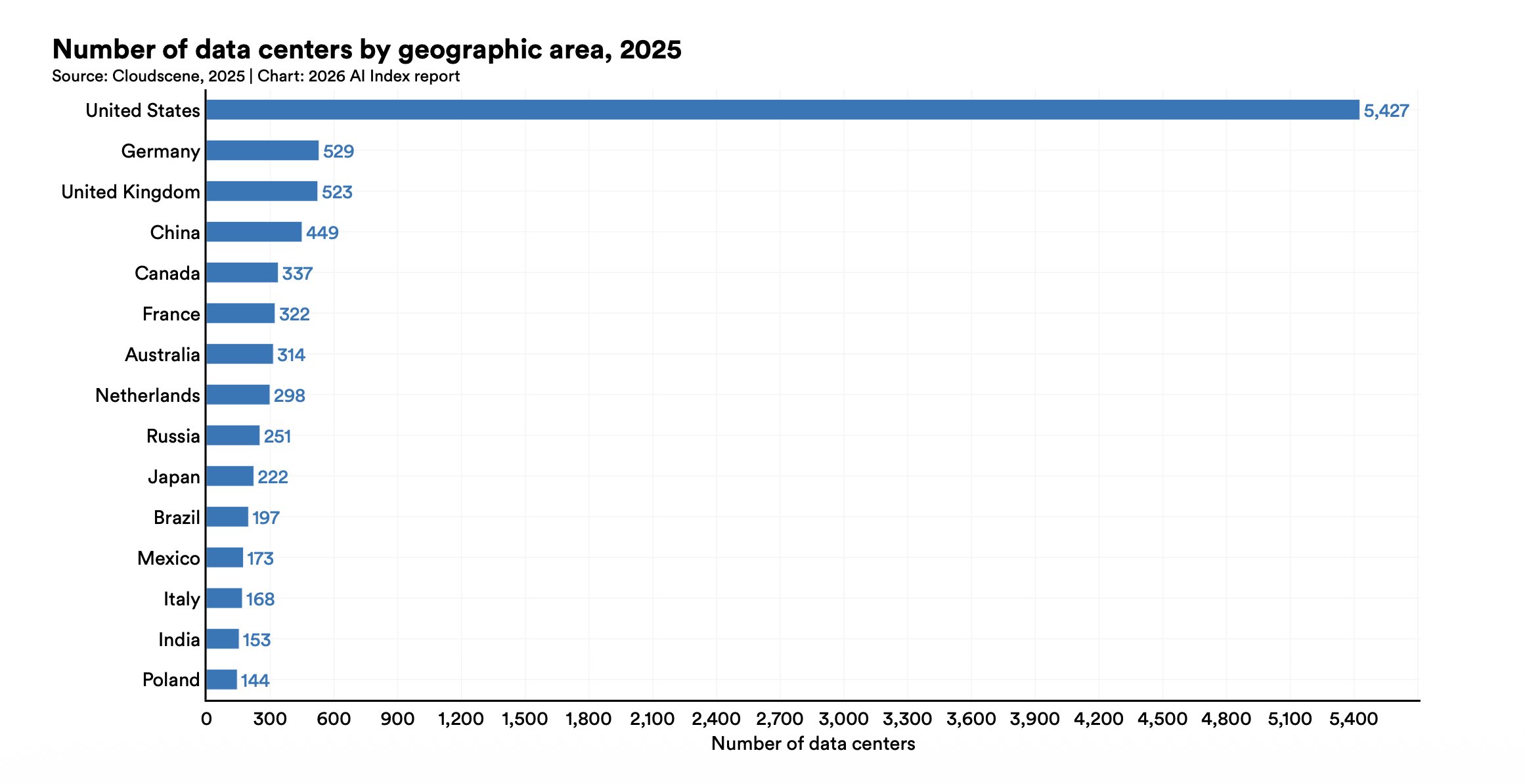

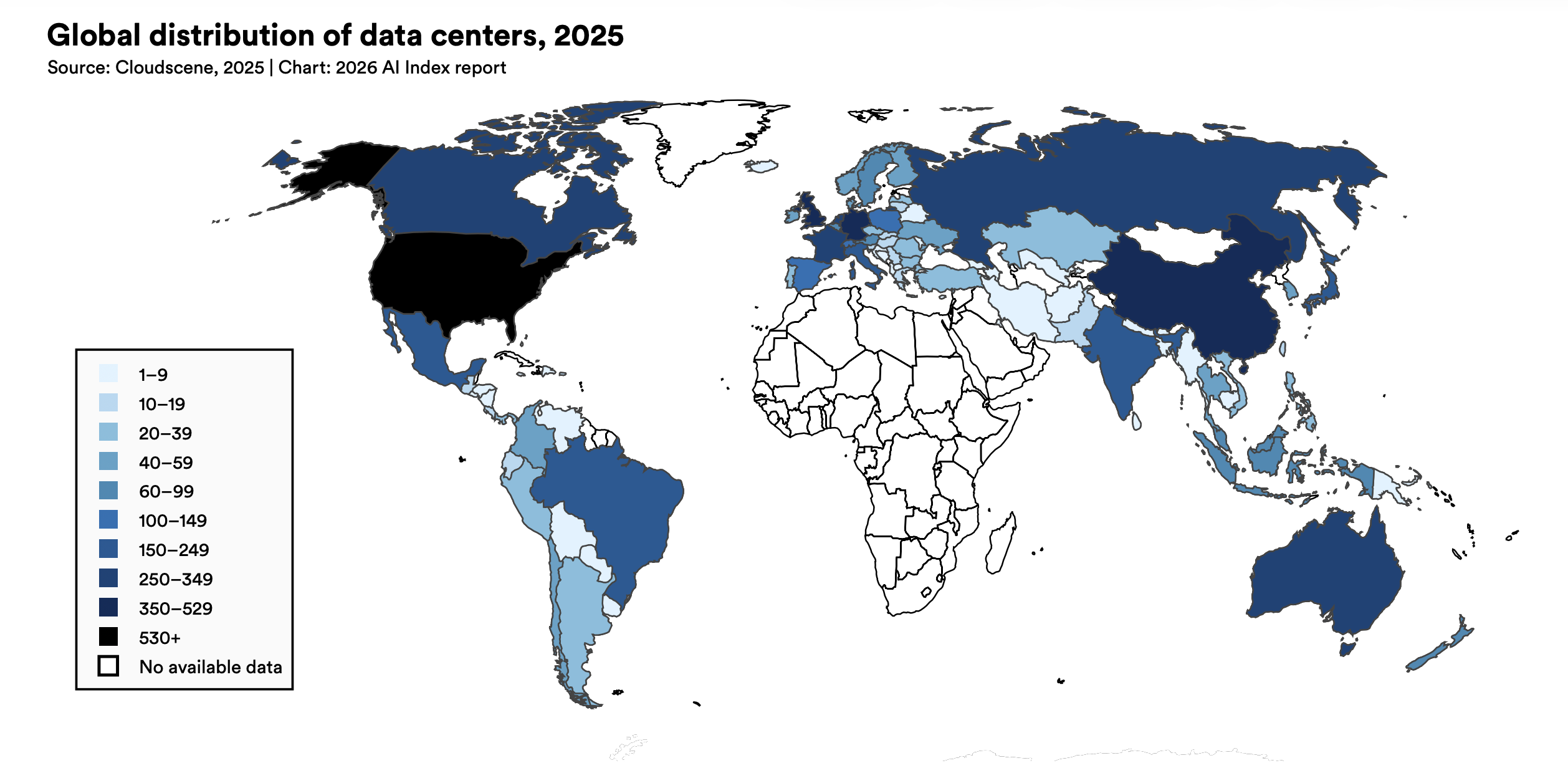

- Gli Stati Uniti ospitano 5.427 data center, più di 10 volte qualsiasi altro paese.

- Un'unica azienda - TSMC - fabbrica quasi ogni chip AI leader del mondo, rendendo la supply chain hardware globale dipendente da un singolo foundry a Taiwan.

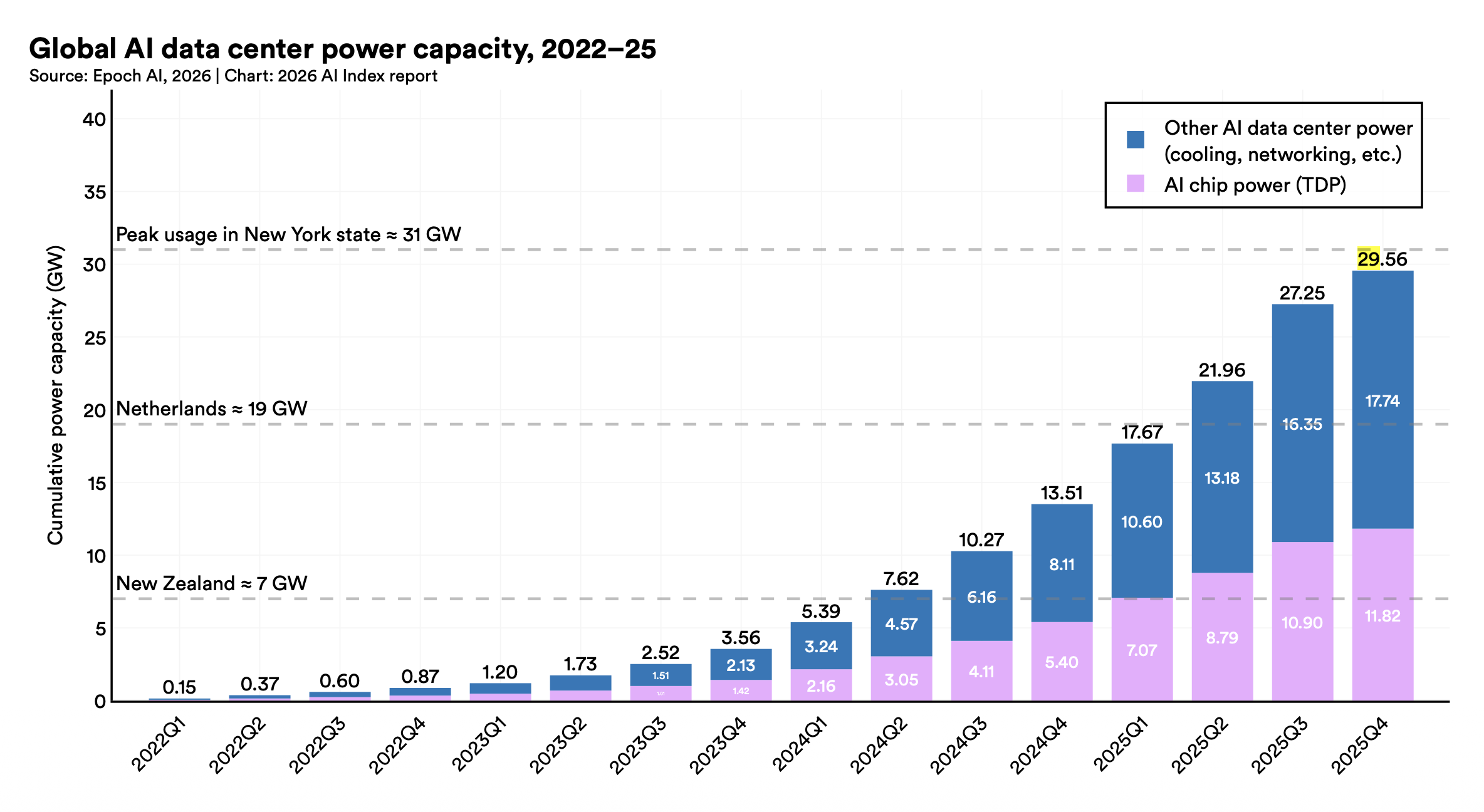

- La capacità totale dei data center AI ha raggiunto 29,6 GW - paragonabile al consumo di picco dell'intero stato di New York.

Sul fronte open source: 5,6 milioni di progetti AI su GitHub, con 30 milioni di stelle cumulative su progetti con almeno 10 stelle. I contributi da aree extra-Europa e extra-USA stanno superando quelli europei, segnalando una redistribuzione geografica della partecipazione.

6. Il costo ambientale è misurabile

Questo è il dato che l'industria fatica di più ad assorbire, perché crea una tensione diretta con la narrativa dell'entusiasmo tecnologico.

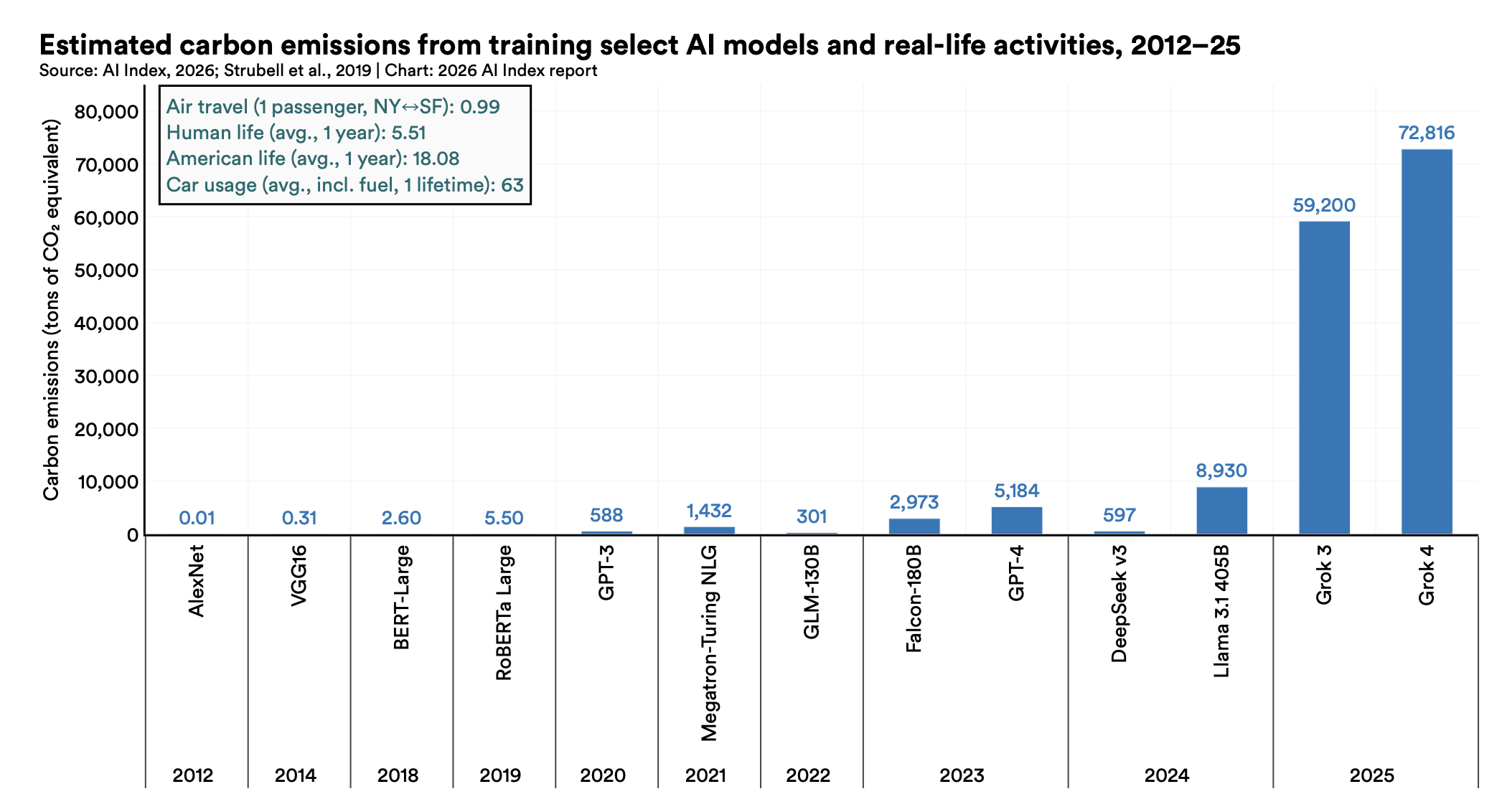

Il training di Grok 4 ha prodotto circa 72.816 tonnellate di CO₂ equivalente - l'equivalente di tenere 17.000 auto in circolazione per un intero anno. Il consumo idrico annuale della sola inferenza di GPT-4o potrebbe superare il fabbisogno di acqua potabile di 12 milioni di persone (usata per raffreddare i server o per alimentarli con idroelettrico).

Inoltre, nel Q4 2025 la capacità totale dei datacenter AI ha raggiunto i 29,6 GW - pari al fabbisogno energetico dell'intero Stato di New York in un giorno di picco estivo - e il consumo energetico cumulativo di tutti i sistemi AI è oggi paragonabile al consumo elettrico nazionale di Svizzera o Austria. E la traiettoria è in accelerazione.

7. La Responsible AI, tra benchmark, incidenti e trasparenza

La Responsible AI riguarda policy making e governance su bias, sicurezza, fattualità e autonomia dei modelli.

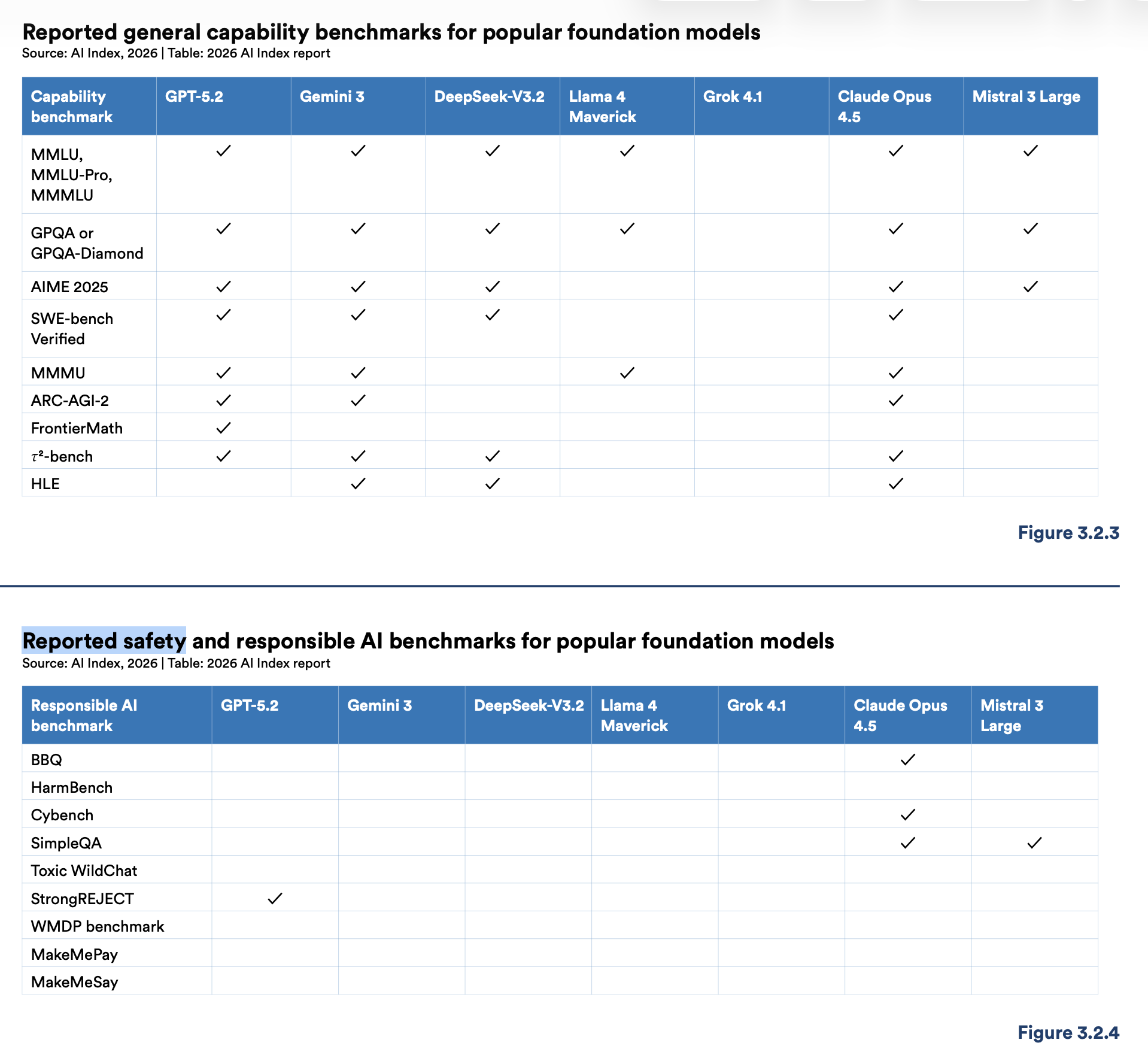

Benchmark: quasi tutti gli sviluppatori riportano risultati sui benchmark di capability (MMLU, GPQA, SWE-bench). La situazione sui benchmark di Responsible AI è radicalmente diversa. Guardando i principali modelli (GPT-5.2, Gemini 3, DeepSeek-V3.2, Llama 4 Maverick, Grok 4.1, Claude Opus 4.5, Mistral 3 Large), la maggior parte delle celle nella tabella Responsible AI è vuota. Solo Claude Opus 4.5 riporta risultati su più di due benchmark RAI.

Questo non significa necessariamente che i lab ignorino la Responsible AI - conducono valutazioni interne, red-teaming, alignment testing. Ma questi sforzi raramente vengono divulgati usando un set comune di benchmark comparabili esternamente.

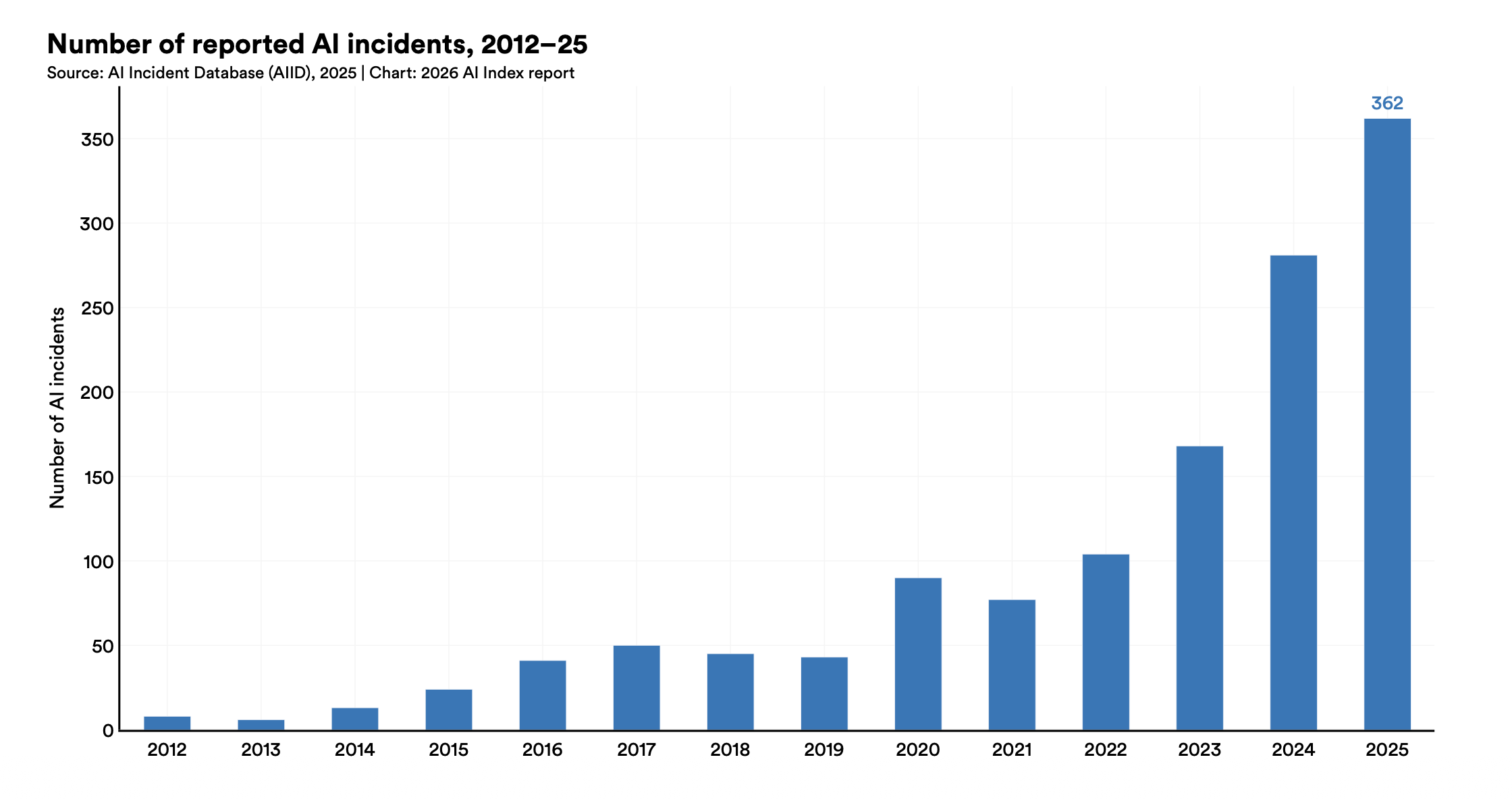

Incidenti: l’AI Incident Database ha registrato 362 incidenti nel 2025, contro 233 nel 2024 - una crescita del 55% in un anno.

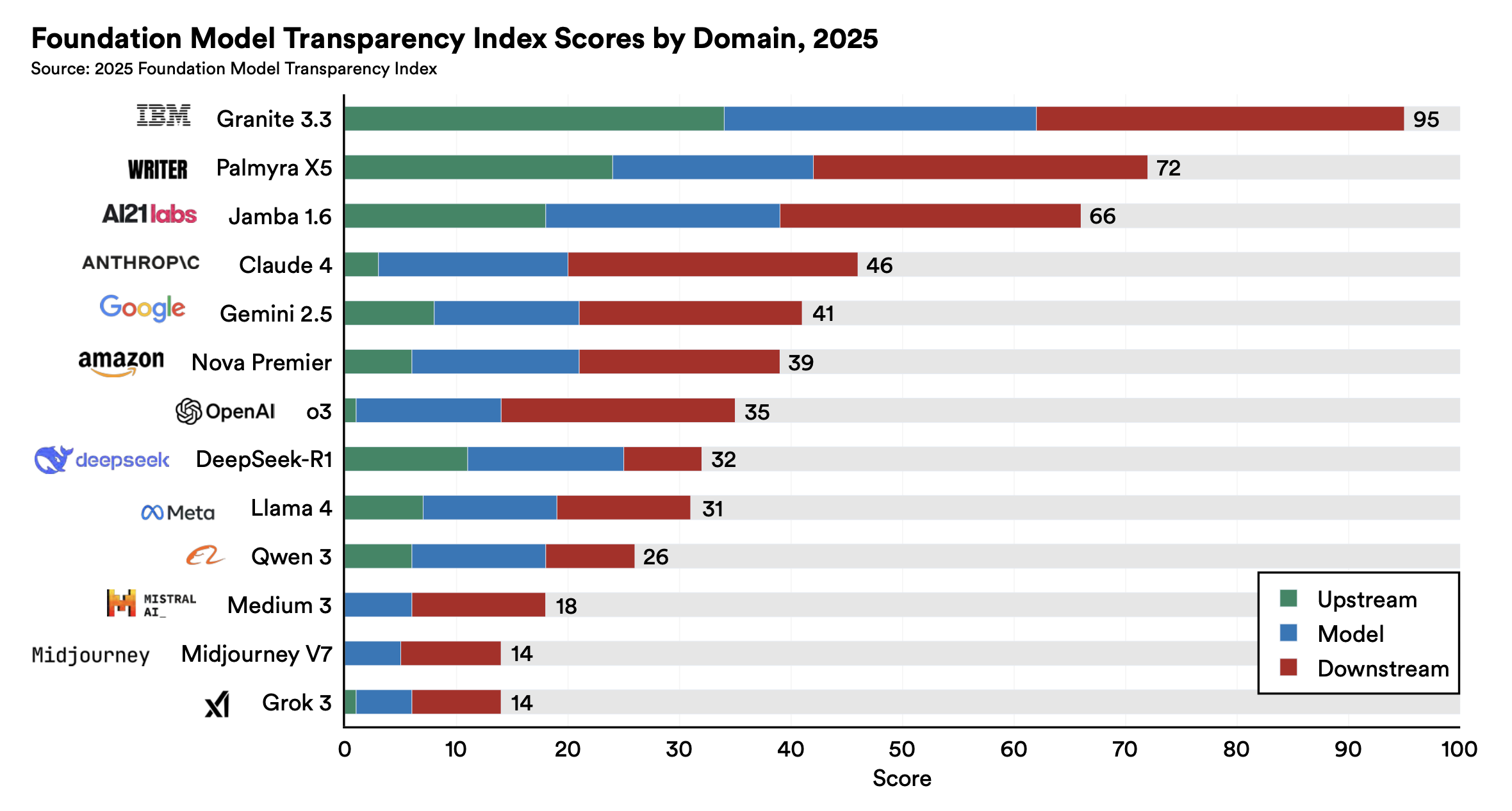

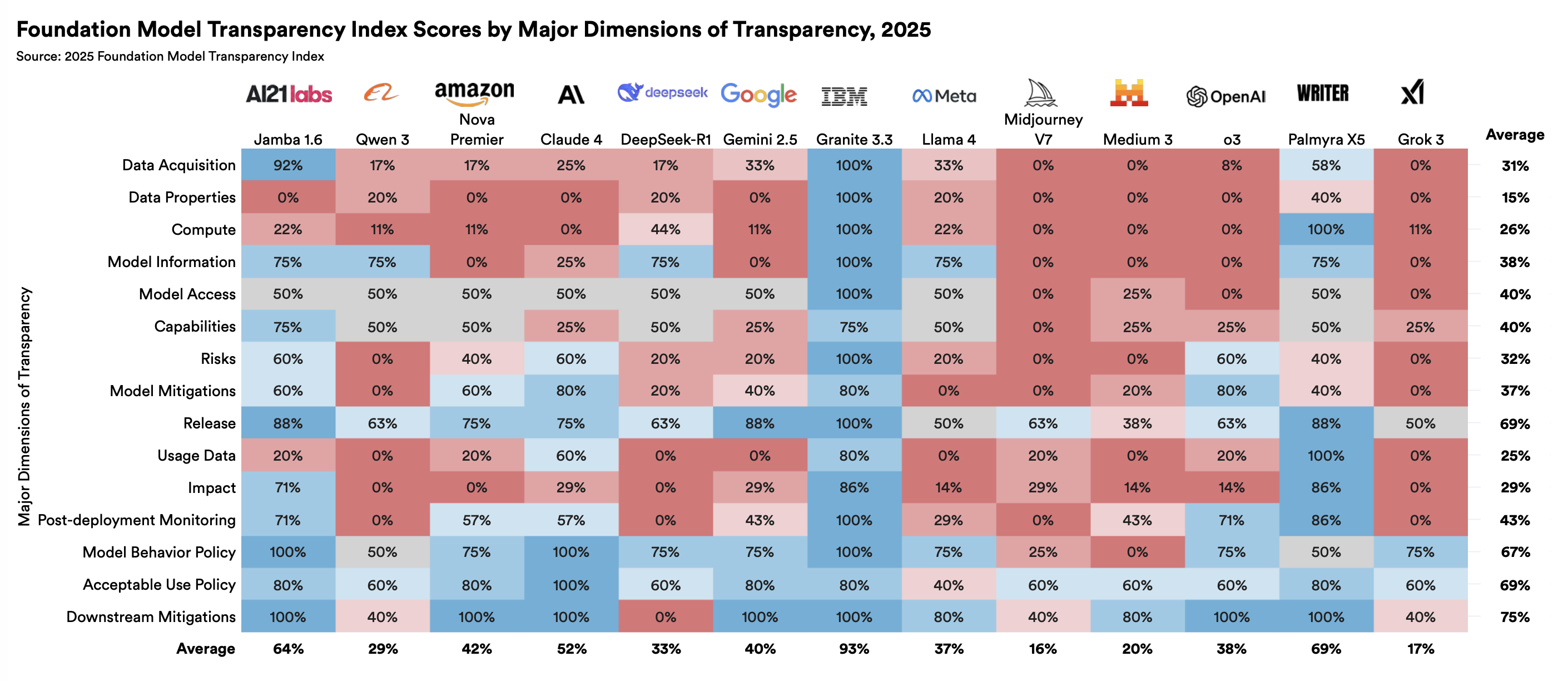

Trasparenza: il Foundation Model Transparency Index - che misura quanto le aziende divulgano su dati di training, compute, capacità, rischi e policy d'uso - è sceso a 40 punti da 58 dell'anno precedente. La correlazione è inversa: i modelli più capaci sono quelli che rivelano meno.

Il trade-off della Responsible AI: ricerche recenti hanno trovato che migliorare una dimensione della Responsible AI (es. safety) può degradarne un'altra (es. accuracy). Non esiste ancora un framework unificato per gestire questi trade-off.

Governance interna: i ruoli specificamente dedicati alla Responsible AI sono cresciuti del 17% nel 2025, e la quota di aziende senza policy di Responsible AI è scesa dal 24% all'11%. Gli ostacoli principali alla piena implementazione restano gap di conoscenza e budget.

8. AI e occupazione

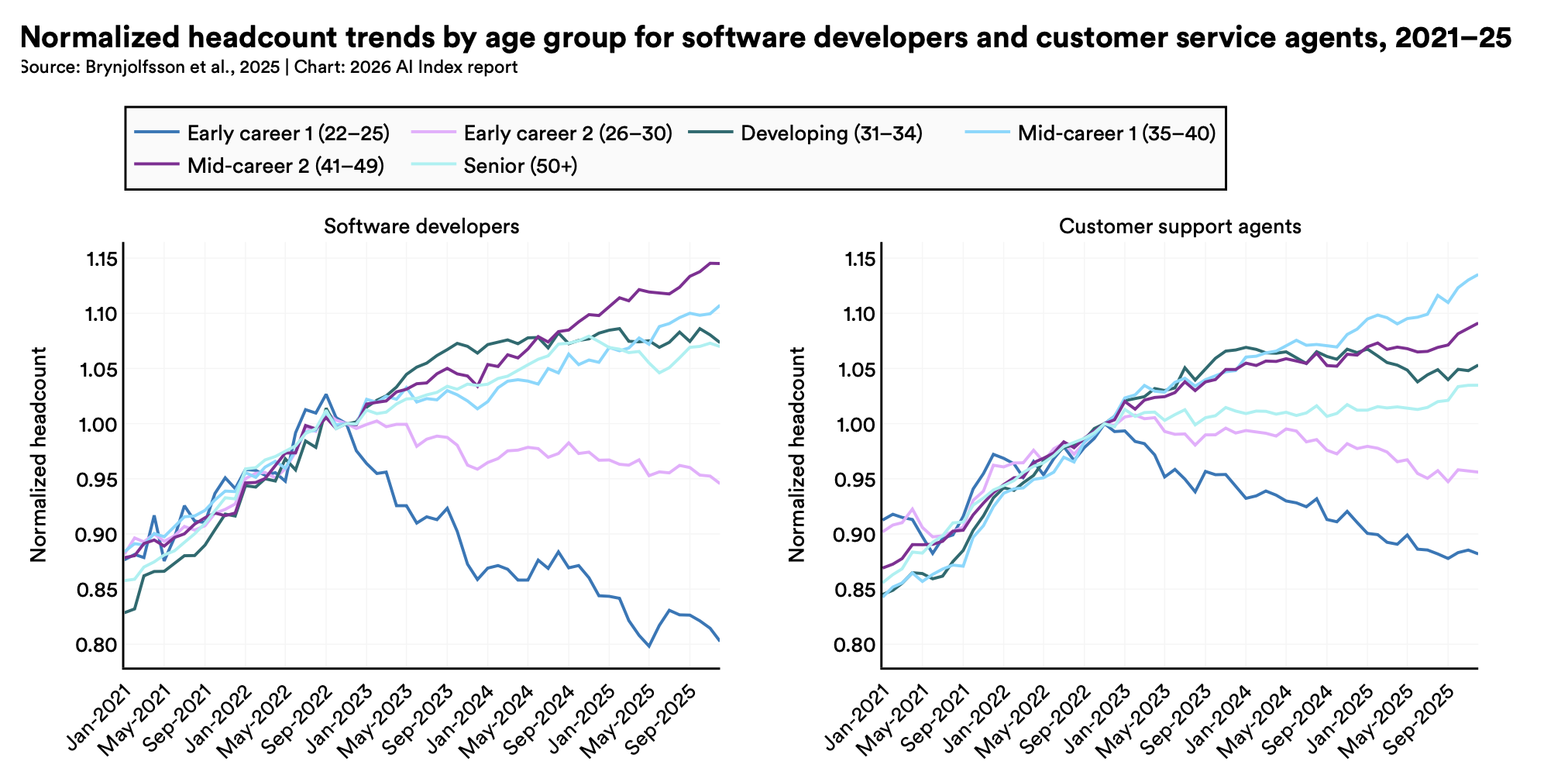

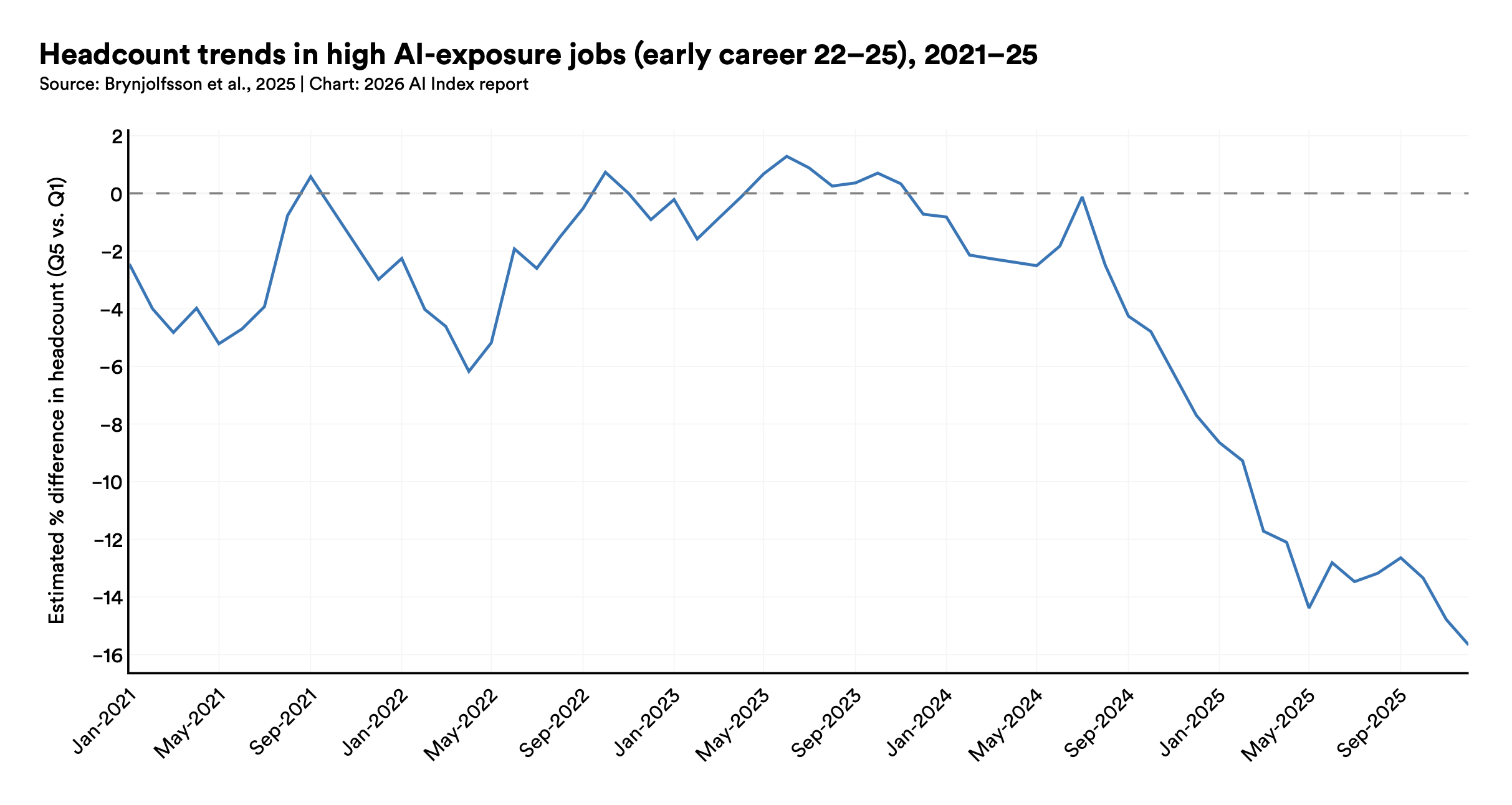

Il dato più netto: i software developer tra i 22 e i 25 anni hanno perso quasi il 20% di posizioni dal 2024, mentre sono aumentati i colleghi più anziani. Il pattern si ripete in altri ruoli ad alta esposizione AI, come il customer service.

Questo non è una proiezione futura, ma una fotografia del presente. E i survey aziendali indicano che i piani di riduzione del personale previsti per i prossimi anni superano quelli già realizzati.

Il report mappa una correlazione diretta: i guadagni di produttività dall'AI appaiono negli stessi settori dove l'occupazione entry-level sta calando. La disruption è targeted (colpisce specifiche fasce di età e ruolo) e just beginning (è appena iniziata).

Per chi lavora in AI Adoption, questa è la questione più urgente da indirizzare: non solo come implementare strumenti AI, ma come preservare la capacità delle organizzazioni di costruire competenza interna nel lungo periodo. Il percorso classico "junior → mid → senior" viene eroso dal basso. Non è ancora chiaro come si formerà la prossima generazione di professionisti tech se i ruoli entry-level scompaiono prima che le competenze si sviluppino.

9. L'America perde talenti a velocità record

Il numero di ricercatori e sviluppatori AI che si spostano negli USA è crollato dell'89% dal 2017. Solo l'anno scorso ha segnato un -80%.

Gli USA guidano ancora per numero assoluto di ricercatori e per investimenti privati (285,9 miliardi nel 2025), ma il flusso in entrata si sta prosciugando a una velocità senza precedenti nel settore tech.

Una nota interessante: il numero di nuovi PhD in AI negli USA e in Canada è cresciuto del 22% dal 2022 al 2024, ma i PhD che compongono quell'incremento hanno preso posizioni in accademia, non nell'industria.

L'effetto netto è che il vantaggio competitivo americano nell'AI dipende sempre più da capitali e risorse computazionali, e sempre meno dall'attrazione di talenti globali.

10. AI nella scienza: da strumento a protagonista

Per la prima volta, il report include un capitolo autonomo sull'AI nella scienza. Il messaggio centrale è che l'AI sta passando da strumento che aiuta a scrivere paper o analizzare dati a sistema capace di generare scoperte.

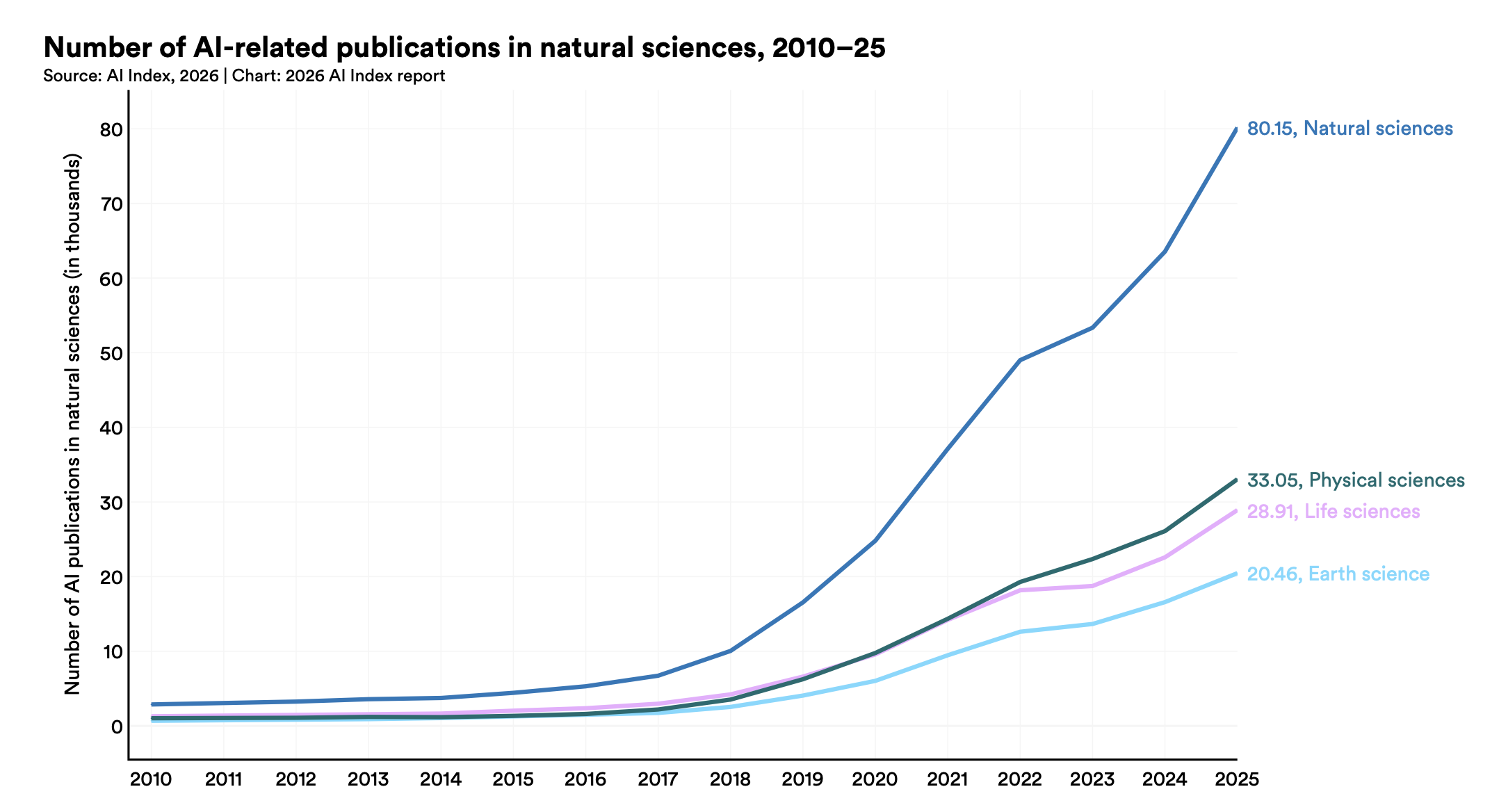

Le pubblicazioni AI-related nelle scienze naturali, fisiche e della vita sono cresciute tutte del 27-28% anno su anno nel 2025, raggiungendo circa 80.150 pubblicazioni nel totale delle scienze naturali.

Bisogna notare che la maggior parte dei modelli AI per la scienza proviene da istituzioni accademiche e governative, in contrasto con il panorama dominato dall'industria per l'AI general-purpose.

Alcuni highlight concreti del 2025:

- Meteorologia: per la prima volta, un sistema AI ha gestito una pipeline completa di previsioni meteorologiche end-to-end. Aardvark Weather ha sostituito la tradizionale pipeline di previsione numerica con un singolo sistema ML. FourCastNet 3 genera previsioni globali a 60 giorni in meno di 4 minuti, da 8 a 60 volte più veloce degli approcci precedenti.

- Astronomia: è stato rilasciato AION-1, il primo foundation model per l'astronomia, addestrato su oltre 200 milioni di oggetti celesti da 5 survey principali. StarWhisper Telescope automatizza le osservazioni astronomiche attraverso 10 telescopi.

- Matematica: Gemini Deep Think ha vinto la medaglia d'oro all'IMO 2025 (da medaglia d'argento nel 2024). Sistemi come Goedel-Prover si stanno muovendo verso la generazione automatica di prove formali in linguaggi come Lean.

- Ricerca scientifica autonoma: il primo paper completamente generato da AI è stato accettato a un workshop peer-reviewed nel 2025 (l’AI Scientist-v2 di Sakana AI a un workshop ICLR). Ma c'è un limite importante: su PaperArena, il miglior agente raggiunge il 38,8% di accuracy contro una baseline PhD di 83,5%. Su BixBench (bioinformatica), i modelli di frontiera raggiungono circa il 17% di accuracy. L'AI in scienza eccelle nelle task isolati, non ancora nella ricerca end-to-end autonoma.

11. AI in medicina: utile in clinica, ma le prove mancano

Anche qui, primo capitolo autonomo nella storia del report.

Quello che funziona: i tool che generano automaticamente note cliniche dalle visite dei pazienti hanno visto un’adozione diffusa nel 2025. Attraverso più sistemi ospedalieri, i medici hanno riportato fino all'83% di riduzione del tempo speso a scrivere note e riduzioni significative del burnout.

Quello che non è ancora provato: una review di oltre 500 studi clinici AI ha trovato che quasi la metà si basava su domande in stile esame piuttosto che su dati reali di pazienti, con solo il 5% che usava dati clinici reali. La valenza clinica dell'AI oltre certi tool specifici rimane speculativa.

Digital twins in crescita: le pubblicazioni sui "data twin" - rappresentazioni computazionali dinamiche di pazienti individuali che si aggiornano nel tempo e supportano previsioni, simulazioni e ottimizzazione del trattamento - sono passate da quasi zero nel 2015 a 372 nel 2025. I primi risultati da trial rigorosi sono promettenti.

12. Adozione globale: più veloce di internet, ma non ovunque

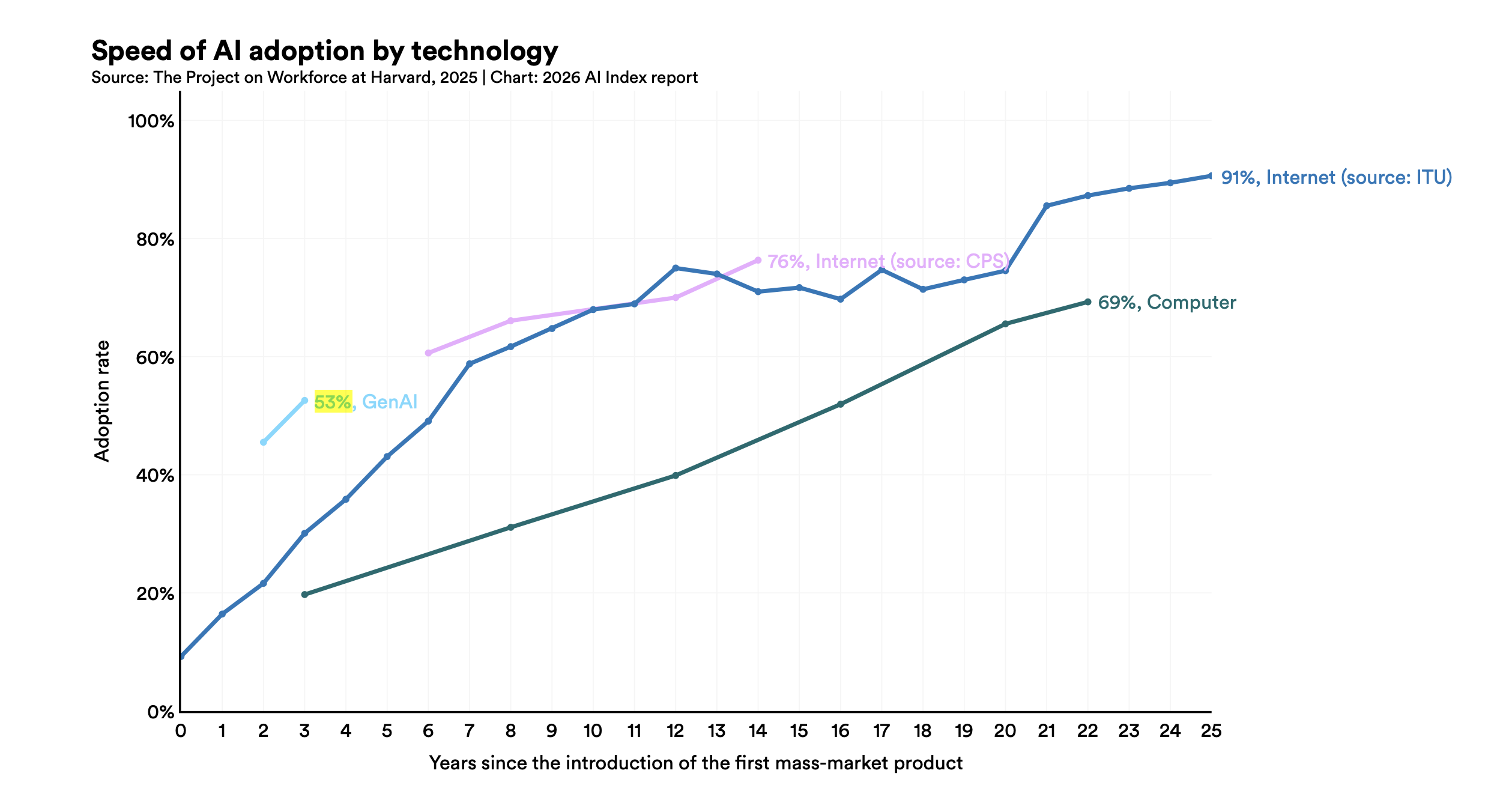

La GenAI ha raggiunto il 53% di adozione globale in tre anni - più velocemente del PC e di internet. In pratica, una persona su due usa l’AI nel mondo. Ma i numeri per paese raccontano una storia più complessa.

I tassi di adozione correlano fortemente con il PIL pro capite, con eccezioni interessanti: Singapore (61%) e UAE (54%) mostrano adozione superiore alle aspettative. Gli USA sono al 28,3%, al 24° posto mondiale - un dato che sorprende considerando che le principali aziende AI sono americane.

Il valore stimato degli strumenti di generative AI per i consumatori americani ha raggiunto 172 miliardi di dollari annui all'inizio del 2026, con il valore mediano per utente triplicato tra il 2025 e il 2026 - un salto notevole che segnala che le persone stanno trovando usi sempre più sostanziali, non solo sperimentali.

13. Istruzione e formazione: il divario si allarga

Quattro studenti di high school e college su cinque usano l'AI per attività scolastiche. Ma solo la metà delle scuole medie e superiori americane ha policy sull'AI, e appena il 6% degli insegnanti le considera chiare.

Al di fuori dell'aula, i professionisti stanno acquisendo competenze AI sia soft (prompt engineering) che tecniche. Le aree che stanno imparando skill di AI engineering più rapidamente sono UAE, Cile e Sudafrica.

Il numero di nuovi PhD in AI negli USA e in Canada è cresciuto del 22% dal 2022 al 2024 - ma, come già notato, quell'incremento è andato in accademia, non nell'industria.

La traiettoria è chiara: la formazione formale insegue, quella informale corre. Le organizzazioni che aspettano che il sistema educativo si allinei prima di strutturare la propria strategia AI rischiano di aspettare molto a lungo.

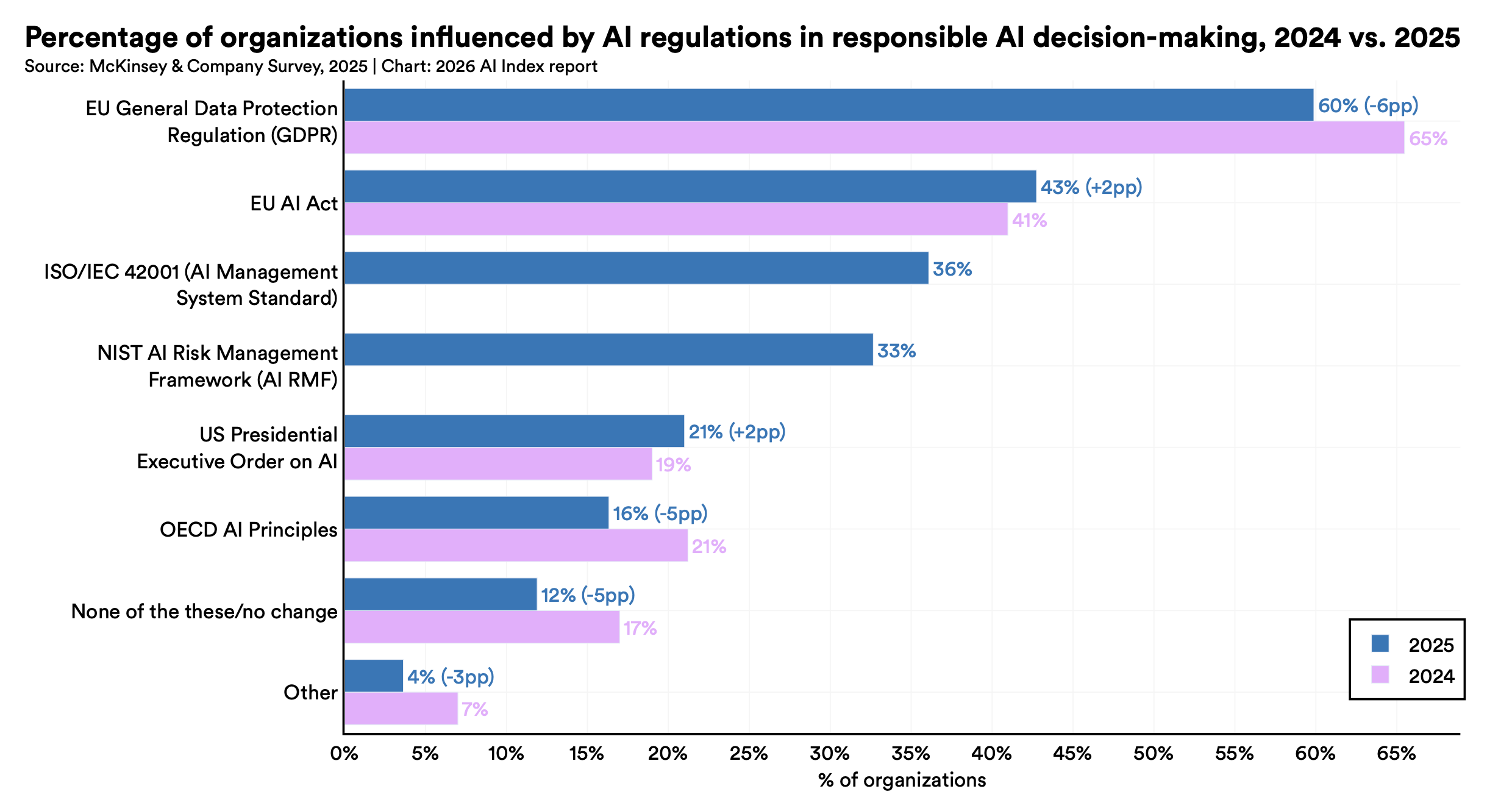

14. Governance e policy in diverse direzioni

Il 2025 ha visto i governi muoversi sull'AI in modo sincronizzato solo sul timing, non sulla direzione.

- EU AI Act: le prime proibizioni sono entrate in vigore nel 2025.

- USA: il paese ha virato verso la deregolamentazione.

- Giappone, Corea del Sud, e altri: hanno preso posizioni intermedie, con strategie nazionali in espansione.

Da notare che i paesi in via di sviluppo stanno entrando nel panorama delle policy AI per la prima volta, e il concetto di sovranità AI - controllo domestico sugli ecosistemi AI - è emerso come tema centrale della policy nazionale.

La concentrazione dell'infrastruttura rimane estrema: USA (5.427 data center),con il chip critico fabbricato quasi interamente da un unico foundry in Taiwan (TSMC). Questa concentrazione è sia un dato di fatto strategico che un rischio sistemico.

15. AI e opinione pubblica

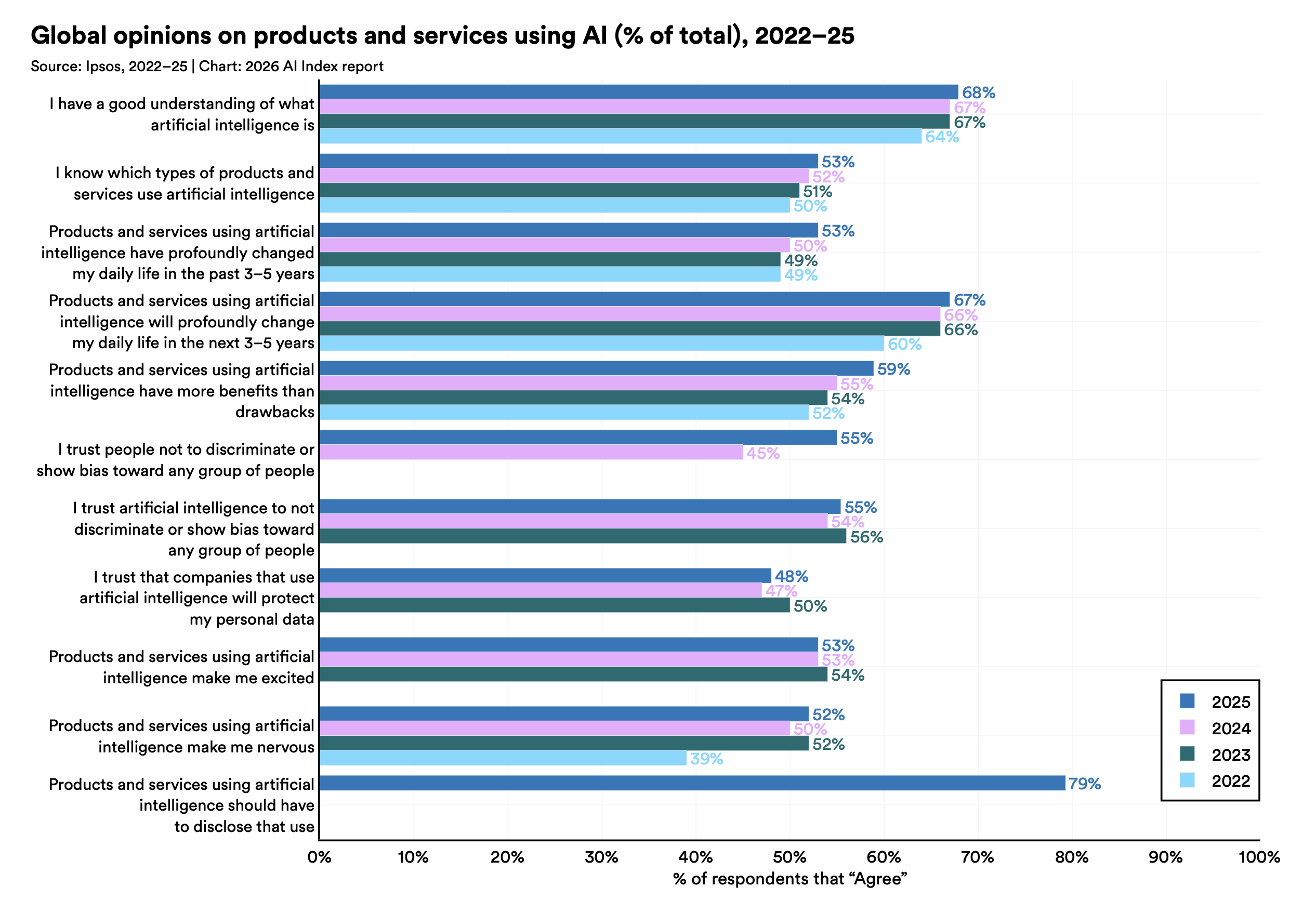

In una survey globale sulle percezioni pubbliche dell'AI:

- Il 59% delle persone si dice ottimista sui benefici, in crescita dal 52%.

- Il 52% si dice nervoso riguardo alla tecnologia, in crescita del 2%.

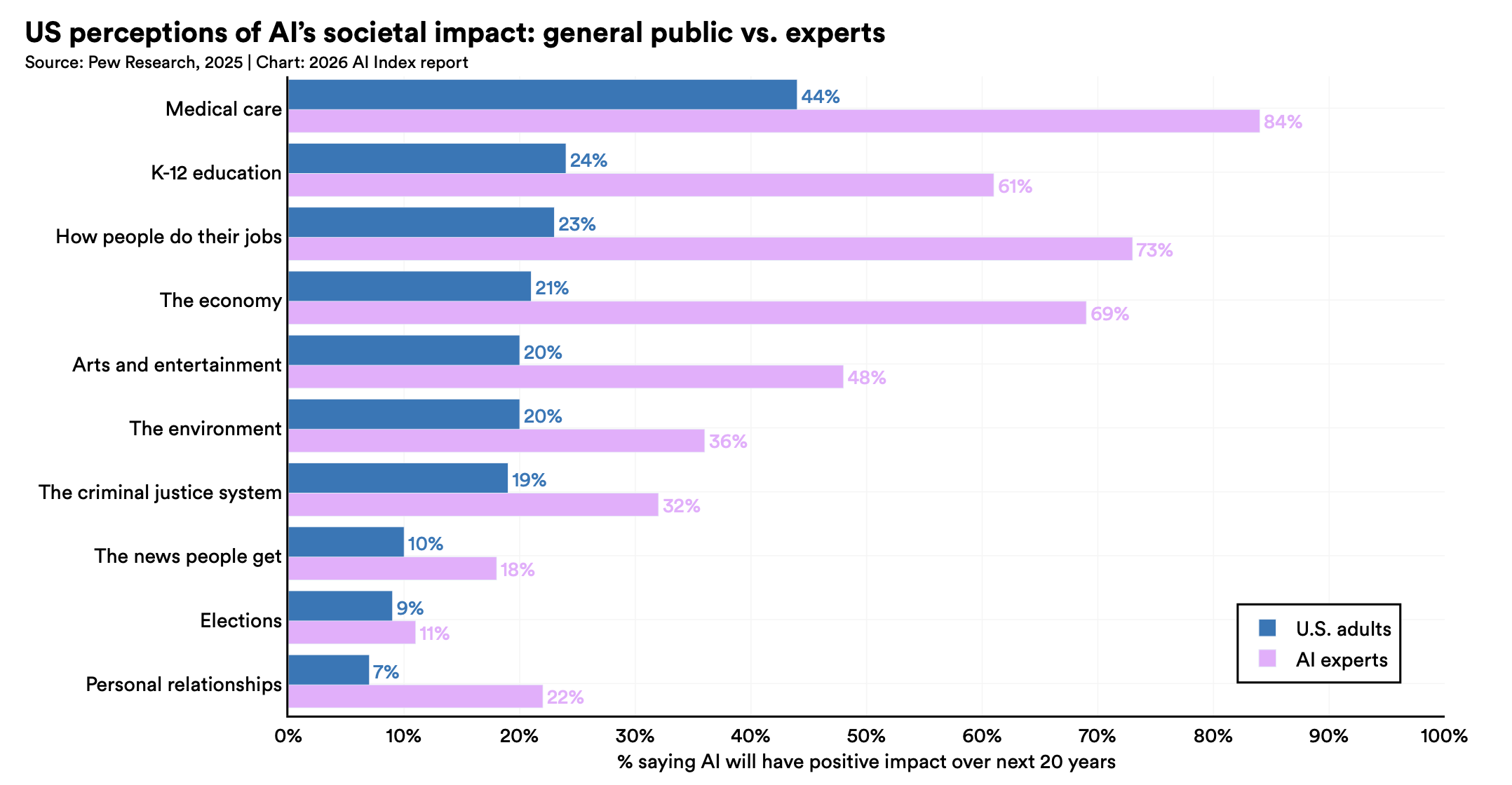

Il dato più interessante è il gap esperto/pubblico. Sul tema "impatto dell'AI sul proprio lavoro": il 73% degli esperti si aspetta un impatto positivo, contro solo il 23% del pubblico generale - 50 punti di differenza. Gap simili emergono sull'economia e sulla medicina.

Gli USA sono tra i più scettici: solo il 33% degli americani si aspetta che l'AI migliorerà il proprio lavoro, contro una media globale del 40%. Gli americani sono anche tra quelli con le aspettative più alte di eliminazione di posti di lavoro senza creazione di nuovi.

Il dato più clamoroso sulla governance: gli USA riportano il più basso livello di fiducia nel proprio governo per regolamentare l'AI, al 31% tra i paesi nella survey. A livello globale, l'UE è considerata più affidabile degli USA o della Cina per regolamentare l'AI efficacemente.

Cosa ci dice davvero questo report

L'AI Index 2026 potrebbe essere letto come un catalogo di trionfi tecnici. I modelli sono più capaci che mai. L'adozione cresce a ritmo storico. Gli investimenti si misurano in centinaia di miliardi. L'AI vince alle Olimpiadi di Matematica e gestisce previsioni meteorologiche end-to-end.

Ma la lettura più onesta è un'altra: stiamo costruendo sistemi sempre più potenti con una capacità decrescente di capirli, misurarli e governarli.

La trasparenza dei modelli cala mentre la potenza sale. I benchmark di capability saturano in mesi. Il reporting sulla Responsible AI è quasi assente. Gli incidenti documentati crescono del 55% in un anno. L'impatto occupazionale si materializza prima che esistano risposte sistemiche. Il flusso di talenti globali verso gli USA si è quasi azzerato. E il paese che ospita il 90% dell'industria AI ha il più basso livello di fiducia nel suo governo per gestirla.

L'AI Index 2026 fotografa un settore entrato in una fase di maturazione asimmetrica: capacità, costi ambientali e disruption occupazionale scalano in sincronia, mentre governance, trasparenza e formazione strutturata restano indietro.

Per chi opera in ambito enterprise o fa policy, la questione non è più se o quando adottare l'AI, ma come gestirne le esternalità ambientali, sociali e competitive prima che diventino strutturalmente ingovernabili.

Da Datapizza seguiamo questo spazio ogni giorno e il messaggio che ci portiamo dal report è che le organizzazioni che vincono non saranno quelle che adottano più in fretta, ma quelle che adottano con più consapevolezza.

Ne abbiamo parlato anche in una puntata del nostro podcast Algoritmi!

Simone Conversano - AI Transformation Specialist - Datapizza